WPS隐私政策引信任风波AI训练数据何以平衡开发和保护?

21世纪经济报道记者郑雪北京报道

近日,金山办公更新的隐私政策掀起一阵波澜。

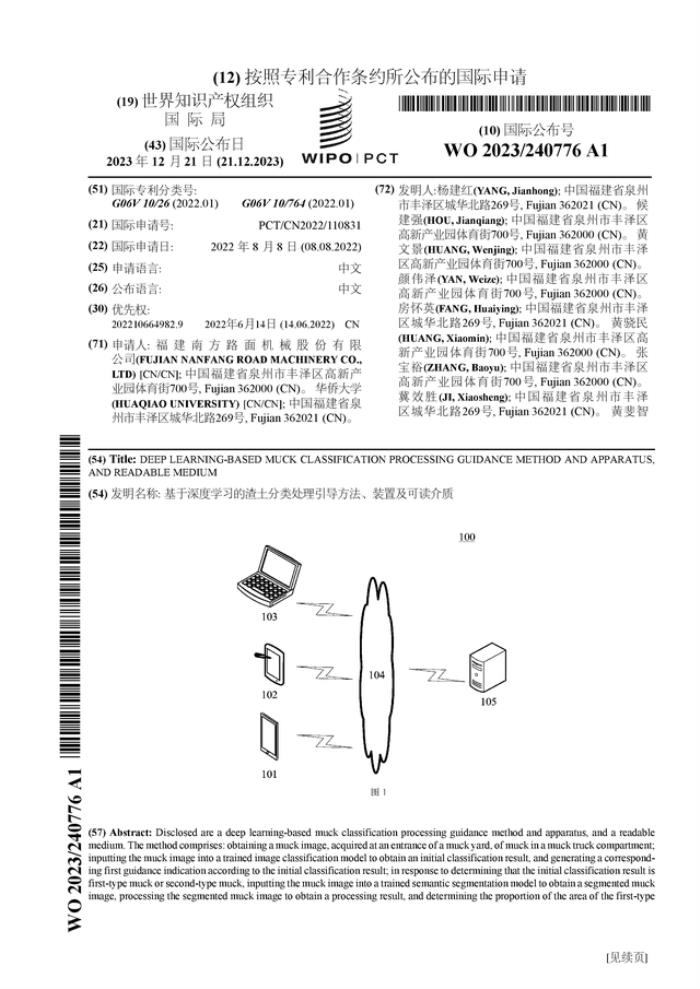

有用户针对WPS隐私政策表达质疑:是否会通过用户的文档内容喂养AI。根据WPS隐私政策,将对用户主动上传的文档材料脱敏处理后用于AI训练的基础材料使用。据了解,该隐私政策更新于11月15日。11月16日,WPS AI宣布开启公测,面向全体用户陆续开放体验。

AI带来的巨大想象力让不少企业纷纷押注。而当前最火的生成式人工智能建立在海量数据基础之上,如何获取足够的数据用于训练早已成为相关企业迫切需要解决的问题。金山办公隐私政策事件的背后,需要思考和回应,当前AI发展,如何弥补海量数据缺口以及如何保护数据开发和利用中的隐私。

隐私政策引发的风波

根据金山办公11月15日更新的隐私政策,4.2.1在线服务提及,“为提升您使用我们提供的包括但不限于在线文档美化、在线PPT美化、在线表格美化的AI功能的准确性,我们将对您主动上传的文档材料,在采取脱敏处理后作为AI训练的基础材料使用,同时请您放心,我们将采取严格的安全措施和技术手段对该资料进行去标识化处理,以降低其他组织或个人通过去标识化处理后的个人信息识别到您的风险、保护您的个人信息。”

16日,有相关用户在社交媒体发文质疑,同时不少用户称感觉其个人隐私受到侵犯。事情发酵两天之后,11月18日深夜,WPS官方微博表示,之前版本的相关表述为用户造成困扰。为此更新《WPS隐私政策》,去除容易引起误解的表述,并确保内容与实际操作严格对应。同时郑重声明,“所有用户文档不会被用于任何AI训练目的,也不会在未经用户同意的情况下用于任何场景。”

同时金山办公重申,WPS始终严格遵守所有可适用的用户隐私保护法律和标准。为进一步加强用户信任,将定期进行隐私政策的审查,并通过第三方独立机构进行合规性审核,以确保承诺得到兑现。

20日记者通过WPS Office查询WPS隐私政策,已无相关AI表述,“当您使用我们目前所提供的在线预览、编辑、多人在线协同编辑、文档分享、文档实时保存至云端等需要在云端实现的功能及后续推出依托于云的服务时,需要您在联网状态下、登录账号后将相关文档材料主动上传(包括您手动上传及/或主动开启的自动上传)至云端,我们将基于为您提供前述云服务,所必要收集您上传至云端文档及文档信息(包括文档类型、大小、页数、修改时间、文档权限、存放位置)。请您放心,您使用在线服务过程中主动上传至云端的文档内容数据,我们仅以为您提供相关服务之目进行处理,不会用于任何与该服务无关的场景、目的。”

至此,金山办公人工智能因隐私政策引起的风波告一段落。

AI训练数据的保护与开发

金山办公AI隐私政策风波背后,需要回答更深层次的问题是,如何弥补海量训练数据缺口,以及,如何保护数据开发利用中的隐私。生成式人工智能是大力出奇迹的典型代表。海量数据作用之下,AI可以自信回应一切内容。而当前一个紧迫的问题在于,数据总有一天会被用完,相关研究表示,高质量的语言数据存量将在2026年耗尽。随着入局者增多,数据海量缺口如何弥补?

据了解,AIGC厂商的数据来源大致分为三个面向,各个厂商历史积累的数据、公开渠道爬取的数据、各类免费或付费的第三方数据库与数据集。

当前,收集公开信息用于训练数据,成为不少厂商丰富数据的选择。如谷歌、X(前twitter)、Meta表示将收集公开数据予以训练。

今年7月,谷歌更新隐私政策,表示将利用网络公开数据训练旗下的AI模型。谷歌表示,“我们可能会收集公开的在线信息或来自其他公共来源的信息,帮助训练Google的人工智能模型。”

根据X今年9月29日生效的隐私政策2.1规定,“We may use the information we collect and publicly available information to help train our machine learning or artificial intelligence models for the purposes outlined in this policy。”即X可能会使用收集的信息和公开信息来帮助训练机器学习或人工智能模型。

Meta产品管理总监 Mike Clark在9月发表的《Privacy Matters: Metas Generative AI Features》一文表示,生成式 AI 模型需要大量数据来进行有效训练,因此使用多种来源进行训练,包括在线公开的信息、许可数据以及来自 Meta 产品和服务的信息。私人帖子、私人消息内容则不在训练范围之内。

公开数据的使用是否合规?竞天公诚律师事务所合伙人袁立志此前在接受记者采访时表示,无论在我国还是域外,对公开数据的正常收集和使用,在一般情况下不算违法。

同时在袁立志看来,解决行业高质量数据缺口问题,首先还是需要相信市场的力量,随着优质数据的需求逐渐显现,各个市场主体都会被“无形的手”推动向前。

同时弥补训练数据缺口时需要回答的一个问题,如何保护用户的隐私?每个公司都有相关保护实践,但最重要的一点,尊重用户的权利和选择。

以OpenAI为例,根据OpenAI中文文档的数据使用政策,从2023年3月1日开始,其对数据使用和保留政策做出了两项更改:“除非您明确决定与我们共享您的数据,否则OpenAI将不会使用通过我们的API提交的数据来训练或改进我们的模型。您可以选择加入以共享数据。通过API发送的任何数据将被保留用于滥用和误用监控目的,最长时间为30天,之后将被删除(除非法律另有规定)。”

从法律角度来看,在人工智能发展链条中,数据处理主体和数据被处理的主体呈现多元化,责任链条难以界定,如何解决该问题?相关主体的权利和义务如何划分?

2023全球数字经济大会人工智能高峰论坛上,中国政法大学互联网金融法律研究院院长、中国政法大学教授李爱君从数据本体出发,认为数据拥有内容层和载体层,在数据使用过程中,要尊重数据客体内容层和载体层的相关权益。在她看来,训练数据使用的法理关系其实事关数据处理,主体包括数据处理主体和数据被处理的主体。对于人工智能链条中数据主体多元、责任难以清晰划分的情况,未来值得进一步探讨。

(记者冯恋阁亦对此文有贡献)

(文章来源:21世纪经济报道)

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

热门文章

21世纪经济报道

2023-11-21

21世纪经济报道

2023-11-21