当心照片实时视频换脸!工信部将推手机端AI换脸诈骗提醒功能

8月19日消息,随着科技的飞速发展,给我们的生活带来了许多便利,也让电信网络诈骗的花样多了起来。

日前,央视新闻频道报道了湖北黄石破获的一起用AI换脸技术解锁社交账号并倒卖获利的诈骗案。

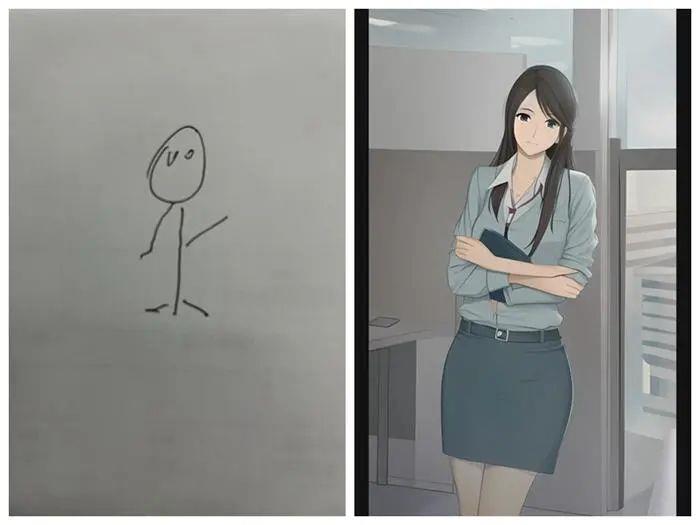

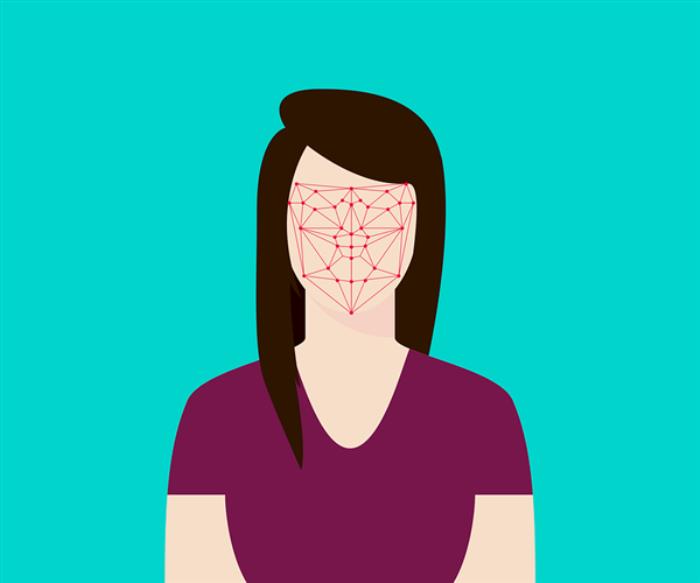

报道提到,在AI时代,肉眼所看见的也不一定是真相,一些不法分子利用“AI换脸”技术实施诈骗,已成为一种新型骗局。

一张“肖像照片”、一段“貌似熟人的视频”,都可能被不法分子利用作为诈骗的手段和工具。

据央视网报道,工信部反诈工作专班专家介绍,除了让照片上的人像活化,AI换脸技术还能实现在即时视频通信状态下的实时换脸。

如果该技术被不法分子掌握,就可能在即时通信或者社交软件上伪装成他人,开展相应的诈骗活动。

工信部专家表示正会同行业内的手机终端企业,将推出AI换脸诈骗风险提醒功能。

这项功能仅在手机端来本地运行,能够有效保护用户数据不泄露,经过用户授权后,可为用户提供AI换脸诈骗风险预警提醒。

根据测试,当用AI换了脸的技术人员与测试方发起视频通话时,测试手机终端提示“对方疑似假冒身份”,点击检测按钮,经过图像扫描,系统提示“AI换脸合成概率93%”。

相关推荐

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

热门文章

新火种

2024-08-19

新火种

2024-08-19