word2vec作者曝与Ilya等十年积怨:seq2seq也是我的想法

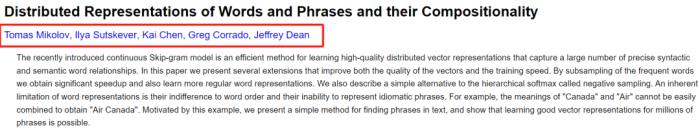

里程碑式论文word2vec获得NeurIPS时间检验奖,可谓实至名归。

但一作Tomas Mikolov在Facebook上发表的长篇获奖感言,却充满了失望和不满。

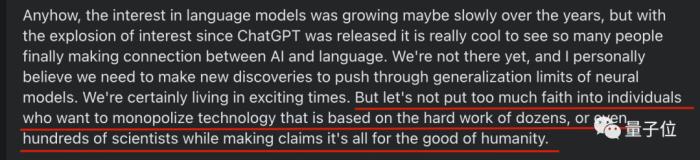

论文最初被ICLR拒稿都算小事了,他还暗讽了OpenAI首席科学家Ilya Sutskever(当时两人都在谷歌):

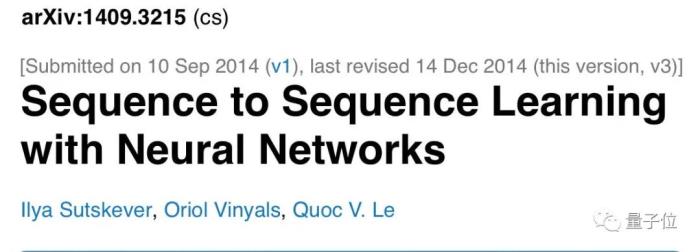

Mikolov话中所指的是word2vec之后又一个里程碑式研究seq2seq,发表于2014年,不出意外的话也将会获得2024年的NeurIPS时间检验奖。

Tomas Mikolov声称seq2seq的想法最初来自于他,在谷歌大脑工作期间与Quoc Le和Ilya有过多次讨论。

但他跳槽到Facebook后,很惊讶看到最终发表的成果中自己没有成为共同作者。

从word2vec到seq2seq

最初word2vec论文投稿到首届ICLR会议(当时还只是一个workshop),尽管接受率高达70%,但还是被据搞了。

这让Mikolov感慨,审稿人想要预测一篇论文未来的影响是多么困难。

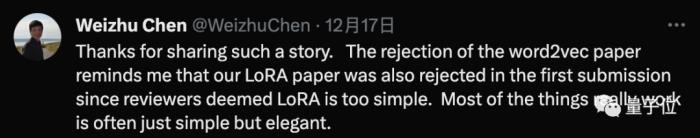

不少研究者都有同感,如今在大模型与AI绘画都大量应用的LoRA作者微软Weizhu Chen透露,当初第一次投稿时也被拒了,因为审稿人认为太简单。

Mikolov这些年听到了很多对word2vec的评论,正面负面都有,但并没有真正在网络上回应过。

借着这次获奖加10周年的机会,Mikolov分享了一些这篇经典论文的背后故事。

首先是很多人抱怨word2vec的代码很难理解,甚至有人以为Mikolov是故意让大家看不懂的。

现在他澄清了“不,我还没那么邪恶”,只是在等待被批准发布代码的几个月中试图让它更短、更快,最终代码被过度优化了。

尽管word2vec是Mikolov被引用次数最高的论文,但他却从未认为这是自己最有影响力的项目。

实际上word2vec最初是他的RNNLM项目中一个子集,这个项目很快被人们遗忘了。

RNNLM开始于2010年,深度学习还处在黑暗时代,Mikolov列举了其中首次展示的想法:

循环神经网络的可扩展训练,他提出了梯度裁剪(Gradient Clipping)神经语言模型首次生成文本,他从2007年开始就展示这样的例子动态评估字符和子词级的神经语言建模神经语言模型适应,现在被称为微调第一个公开可用的语言模型评测基准,也就是修改后的Penn Treebank数据集

2012年,Mikolov从捷克布尔诺理工大学博士毕业后加入了谷歌大脑。

他表示自己很幸运,那里有大量神经网络的信徒,允许自己研究word2vec、展示其潜力,但他不想给人们留下一切都很完美的印象。

在word2vec之后,Mikolov想通过改进谷歌翻译来普及神经语言模型。开始与Franz Och的团队合作,期间提出了几个可以补充甚至取代当时机器翻译的模型。

核心想法在他加入谷歌大脑之前就已经提出,也就是在不同语言句子对上训练,然后使用生成模型翻译看到的第一句话。

当时在短句子上效果很好,较长句子效果还不佳。他与谷歌大脑中的其他人(主要是Quoc Le和Ilya Sutskever)多次讨论过这个项目,他们在自己跳槽到Facebook后接手。

……

大家看到Mikolov的长篇感言,也是百感交集。

康奈尔大学助理教授Volodymyr Kuleshov借word2vec被拒稿的故事,鼓励大家不要因论文同行评议过程而灰心,“好的想法终会得到应有的认可”。

也有人认为,Mikolov指出的贡献分配、引用数量和影响力等问题,不光是NLP的问题,而是整个AI领域都存在。

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

新火种

2023-12-21

新火种

2023-12-21