百川智能王小川:美国OpenAI要把1000万个GPU连接起来做大模型这种想法像登月一样

10月31日消息,在今天上午举办的2023云栖大会上,百川智能创始人兼CEO王小川发表演讲称,今年年底之前,国内会有几家公司能够做到GPT3.5的水平,明年国内会有若干款超级应用。

王小川表示,百川智能做大模型的理念是“理想上慢一步,落地上快三步”。4月下场之后,百川在两个月时间就完成了第一个70亿参数的模型的发布,行业一般需要半年,比预期时间节省了三倍。

他直言,在大模型领域,确实得承认跟美国存在差距。他预计今年年底之前国内会有几家公司能达到GPT 3.5的水平,到明年也有信心能够达到GPT4.0的水平,但是达到之后,可能很难去超越他们。

他在发言中还谈到在美国与OpenAI交流时了解到的情况。

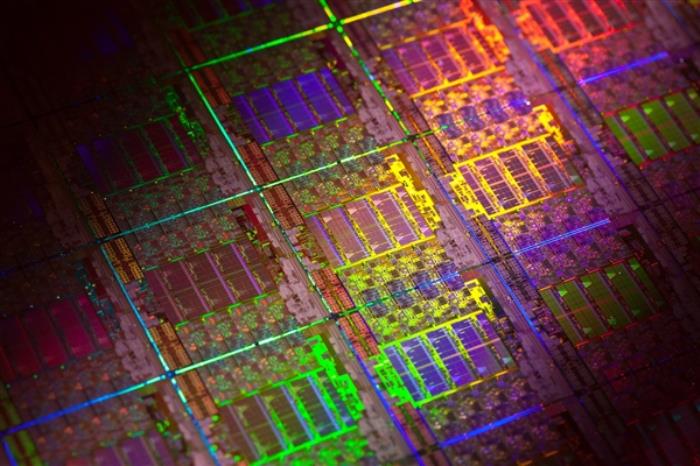

“他们在正在设计一个把1000万颗GPU连在一起做模型的技术。咱们做GPT3.5的时候用了4000颗GPU,做GPT4的时候是25000颗,英伟达一年生产能力才100万颗,而OpenAI在设计把1000万个GPU连接起来,这样一种想法像登月一样。“

“我对他们充满了敬畏。我更自豪的地方是,我们在做应用方面可能比美国走得更快。”王小川表示。

王小川认为,在做应用方面,中国企业会走得很快。基于现在已有的技术,相信中国明年有若干款超级应用。

公开资料显示,百川智能成立于2023年4月10日,由前搜狗公司CEO王小川创立。其核心团队来自搜狗、Google、腾讯、百度、华为、微软、字节等知名科技公司,目前团队规模170余人,研发人员占比超80%。

成立半年,百川智能便接连发布baichuan-7B/13B,Baichuan2-7B/13B四款开源可免费商用大模型及Baichuan-53B、Baichuan2-53B两款闭源大模型,平均每28天就会发布一款新的大模型。

10月30日,百川智能发布Baichuan2-192K大模型,其上下文窗口长度达192K,是目前全球最长的上下文窗口,能够处理约35万个汉字,是目前支持长上下文窗口最优秀大模型Claude2(支持100K上下文窗口,实测约8万字)的 4.4倍,更是 GPT-4(支持32K上下文窗口,实测约 2.5万字)的14倍。

据悉,Baichuan2-192K现已正式开启内测,以API(应用程序接口)调用的方式开放给核心合作方,目前已经与财经类媒体及律师事务所等机构达成了合作,将全球领先的长上下文能力应用到了传媒、金融、法律等具体场景当中,不久后将全面开放。

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

热门文章

新火种

2023-10-31

新火种

2023-10-31