暂停AI训练公开信发起人:中国处于全球AI治理的独特位置

·“现在是东西方共同努力的时候。人工智能的发展将改变大国之间的关系。而中国处于一个为人工智能的安全和明智治理做出贡献的独特位置。对比中国、欧洲和美国,中国迄今为止在监管人工智能方面做得最多,欧洲第二,美国第三。

麻省理工学院(MIT)人工智能与基础交互研究中心教授、未来生命研究所创始人迈克斯·泰格马克(Max Tegmark)。

6月9日,麻省理工学院(MIT)人工智能与基础交互研究中心教授、未来生命研究所创始人迈克斯·泰格马克(Max Tegmark)在2023北京智源大会上发表主旨演讲,谈及为何当下对人工智能的担忧变得更加必要和紧迫,以及要如何控制人工智能。

泰格马克表示:“人工智能将改变大国之间的关系。过去,当人们只关注人工智能给予力量这一方面时,每个人都争相竞逐它。但一旦人们开始认识到这可能会终结地球上的所有文明时,想法就会发生变化。与其把它看作一场军备竞赛,不如将其视为一场自杀式竞赛。无论谁先获得不可控制的超级智能,每个人都将在那时灭亡。因此,我认为现在是东西方共同努力的时候,建立合作伙伴关系而不是竞争关系,以确保我们能够控制人工智能的发展。”

对比中国、欧洲和美国,泰格马克认为中国迄今为止在监管人工智能方面做得最多,欧洲第二,美国第三。他透露,未来生命研究所与欧洲的政策制定者进行了大量合作,包括现在正在推进的欧盟《人工智能法案》。

未来生命研究所(Future of Life Institute)成立于2014年,致力于研究如何最大限度地减少日益发展的人工智能技术可能带来的危害。今年3月,该机构官网发布了引起热议的“暂停AI研究”公开信,呼吁所有AI实验室立即暂停训练比GPT-4更强大的AI至少半年,包括特斯拉CEO马斯克在内的超过1100名科技人士在公开信上签名。

作为这一倡议的发起人之一,泰格马克谈论如何控制AI的话题并不令人意外。但有趣的是,泰格马克多次表示,自己并非“深度学习三巨头”之一杨立昆(Yann LeCun)所说的“doomer”(认为世界正走向毁灭的人),反而他认为,“拥有比我们聪明得多的智能体并非没有可能。前提是我们可以证明它是安全的。”

人工智能已经接近能愚弄人类的水平

如何控制人工智能,确保它为人类服务而不是对抗人类?泰格马克认为这需要解决两个主要问题。

第一是对齐(alignment),即确保人工智能按照其控制者的意愿行事。第二,使全球各组织、公司和个人保持一致,确保他们的动机是将人工智能用于善事而非恶事。“如果我们只解决了第一个问题并广泛应用非常强大的人工智能,那么我们可能会面临这样的情况:恐怖分子或其他希望控制世界并执行我们不希望看到的行动的人,可以利用这项技术。”泰格马克说。

实际上,人类对于能否控制人工智能的担忧早已存在,早在艾伦·图灵时代,就有人表示担忧。过去9年里,包括泰格马克在内的许多人,如物理学家史蒂芬·霍金、加州大学伯克利分校人工智能系统中心创始人斯图尔特·罗素和2004年诺贝尔物理学奖获得者弗兰克·威尔切克等,都曾对这个问题表示担忧。

但泰格马克强调,现在的担忧更加紧迫,因为人工智能已经接近能够愚弄人类的水平,即人工智能通过图灵测试。换句话说,人工智能可以掌握语言,这在过去被许多研究人员认为标志着其非常接近人类所能做到的一切。

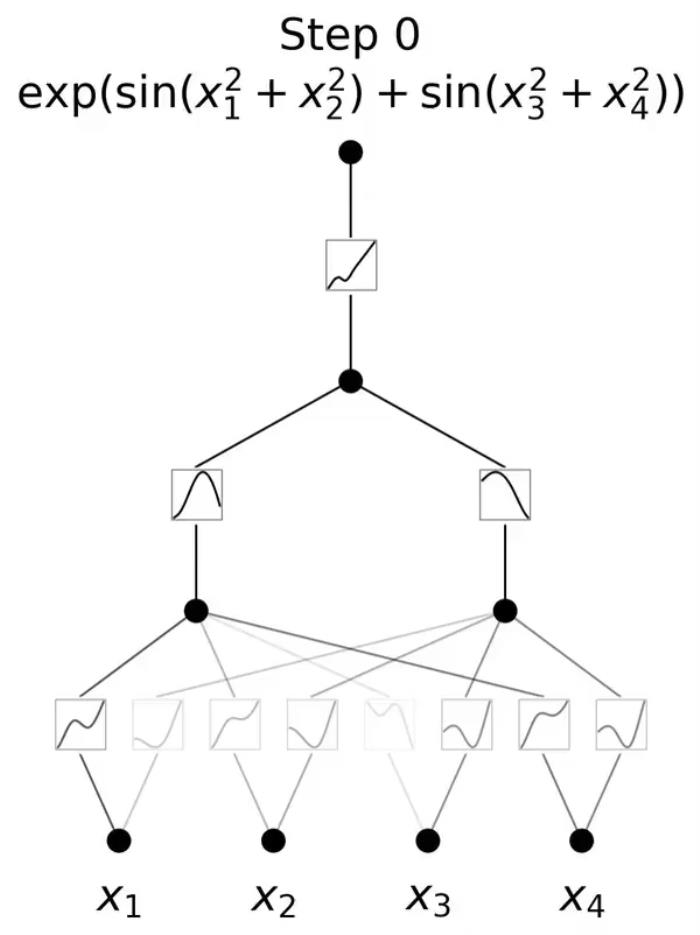

但是,对于未来人类在理解AI系统方面的能力,泰格马克表示他实际上比杨立昆更加乐观。“我认为,如果我们全速前进,将更多的控制权从人类手中交给我们不了解的机器,那人类世界将以非常糟糕的方式结束。但我们不必那样做。如果我们努力研究机械可解释性(研究人类知识如何储存在神经网络的复杂连接关系里,最终解释大语言模型为什么会产生智能),以及许多其他技术主题,我们实际上可以确保这些更强大的智能为我们服务,并用它来创造一个比科幻作家过去梦想的更加鼓舞人心的未来。”

人工智能发展将改变大国之间的关系

对于此前发出的“暂停AI倡议”,泰格马克澄清道,其目的并非是暂停人工智能研究,而只是暂停开发比GPT-4更强大的系统,暂停的目的只是让人工智能像生物技术一样有一定的安全审查。在生物技术领域,一家公司发明一款新药后并不可能隔天就让产品出现在各大药店,而是首先要说服政府的专家它是一种安全的药物、好处大于坏处,经历审查后才可以向大众售卖。

那么如此会破坏创新吗?泰格马克反问道,“当然不是。其实恰恰是对危险品的监管太弱,反而经常破坏创新,比如民用核电,这方面的投资基本上已经崩溃,至少在福岛事件之后的西方是这样。”

泰格马克认为,人工智能的发展将改变大国之间的关系,而中国处于一个为人工智能的安全和明智治理做出贡献的独特位置。

“中国是世界领先的科技大国,所以它可以帮助领导研究。同时不仅是关于如何让AI变得强大,还有如何让它变得更加鲁棒(robust)和值得信赖。由于中国的国际影响力与其启发和塑造全球人工智能议程的能力同步增长,中国的声音真的很重要。就在上周,我非常高兴看到中国的全球安全倡议明确谈及预防人工智能风险。”

据泰格马克透露,未来生命研究所与欧洲的政策制定者进行了大量合作,比如欧盟《人工智能法案》。“如果我们能够帮助欧洲提出真正明智的监管措施,美国很可能会效仿。我们在欧盟GDPR(通用数据保护条例)中看到了这种情况。例如,美国人并不想为了隐私而做任何类似的事情,但在欧盟通过这些法律后,美国人收到的垃圾邮件也开始减少,GDPR所提及的内容也开始在美国越来越流行。”他说。

泰格马克给人工智能领域研究者的建议是专注于基础知识,因为经济和就业市场的变化会越来越快,“我们正在摆脱学习10年或20年然后余生都做同样事情的模式。更重要的是,在扎实的基础之上,要有创造性和开放的思维。当然,要关注整个人工智能领域正在发生的事情,而不仅仅是在自己的领域。因为在就业市场上,首先会发生的事情不是人被机器取代,而是不与人工智能打交道的人将被与人工智能打交道的人所取代。”

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

热门文章

新火种

2023-10-30

新火种

2023-10-30