AI的新现实:大模型“价值对齐”不可或缺

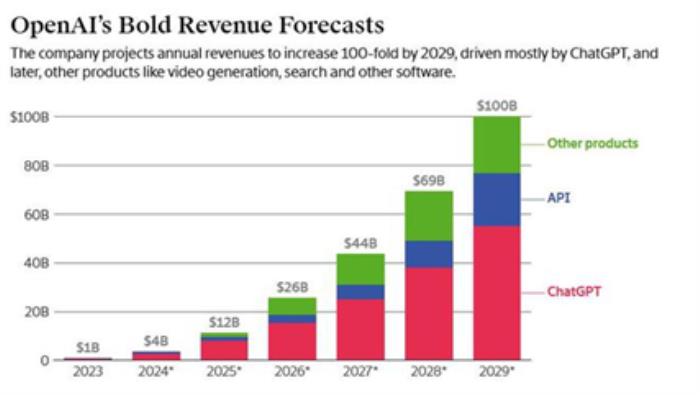

去年OpenAI开启生成式人工智能浪潮,由大模型带动的AI产业一路狂奔。行业快速发展过程中,如何让它的行为跟人类的价值真实意图、伦理原则相一致,这成为学术、政策、产业等领域多方

由腾讯研究院华东基地、腾讯优图实验室主办的第一期“智创沪联”活动周末展开了“头脑风暴”。以“大模型价值对齐”为主题,活动深入探寻价值对齐问题的创新性解决方案与法律伦理治理,确保AI技术符合社会预期,探索AI与人类价值间的平衡。

上海市人工智能行业协会秘书长钟俊浩指出,在行业发展过程中,大模型的“价值对齐”作为一种推动各领域协同发展的有效手段,具有重要的现实意义和深远的影响,还将为全球合作与发展提供新的契机。

价值对齐将成为AI产品的重要竞争力

如何避免数据规模与算力不断提升的AI大模型遭到滥用、生产有害内容,已经是人工智能行业的核心议题之一。正因如此,能够有效增强AI大模型安全与实用性的“AI价值对齐”,才会成为行业

“价值对齐将成为AI产品的重要竞争力。”腾讯研究院秘书长张钦坤认为,大模型价值对齐的实现,需要对齐技术(人类反馈强化学习、AI监督等)、训练数据干预、模型可解释、对抗测试等多种技术和治理措施的结合,同时未来还需要着重考虑如何通过更多的社会参与来形成价值对齐的共识,以及如何使监督、理解、设计AI模型的能力与模型本身的复杂性同步发展,以更好地对大模型进行有效的监督。

“我们期待的是大语言模型可以和人类的价值、真实的意图相一致,确保AI技术可以可靠和安全地服务于人,并且确保社会经济可以健康地增长。”上海交通大学副教授刘鹏飞介绍道。在全球范围内,包括Open AI在内的大部分人工智能推动组织,都在积极运用各种方案加强价值对齐的完善落地,诸如监督精调、基于人类反馈的强化学习、基于检索的事实对齐,以及尝试使用工具对模型进行对齐,都是现阶段被行业寄予厚望的“AI价值对齐”可执行方案。

上海交通大学教授闫宏秀则表示,技术的发展进步,始终遵循着消除风险、力求确定性的趋势,作为应对风险的有效方式,“信任”始终是人类的必选项。没有信任,技术发展的停滞几乎是必然的。让人工智能走向可信、可控、可靠,让人机合作走向现实,“AI价值对齐”正是其中不可或缺的一环。

“以合乎伦理的结构性性能来夯实价值对齐的底层伦理逻辑,以对信任的理性认知构建价值对齐的边界。”闫宏秀教授总结道。

通过立法诠释“AI价值对齐”

明确了技术路径,如何将技术理论结合实际需求尽快落地,无疑是现阶段“AI价值对齐”议题的发展重点。

上海人工智能实验室治理研究中心研究员滕妍指出,想要加速“AI价值对齐”的发展,除了“基于人类反馈进行调整”之外,让人工智能部分监督,或者协调人类技术进行监督,提供一些高质量的反馈数据来提高价值对齐能力,是目前各国热度很高的研究方向之一,包括OpenAI在内都对这个领域投入过不少

“除此之外,在‘确认大模型是否对齐’的评估环节,除了采用人工手段进行验证之外,通过专用的AI模型来进行评测,同样逐渐成为行业的趋势所在。”滕妍认为,从准确率来看,评测模型依旧有提升空间,但从执行与迭代的效率来看,利用AI大模型来加速人工智能价值对齐,前景十分可观。

除了技术与伦理层面, “AI价值对齐”同样在法律层面带来了全新的挑战,来自同济大学法学院的助理教授朱悦介绍,从国内的《生成式人工智能信息安全服务规定》,到欧盟的《人工智能法案》,再到美国头部企业的深度自治试验,在全球范围内,积极推动AI大模型技术发展的国家和地区,都将相关法令研讨提上了日程:“透明、可解释和可问责以及个人层面的隐私保护等详尽问题,都是现如今在立法过程中遇到的挑战。”

朱悦指出,虽然在目前这个“AI价值对齐”依旧处于基础技术迭代的早期阶段,在法律层面上做出定论为时尚早,但从各国政府和跨国企业的积极性来看,通过立法对“AI价值对齐”进行诠释,并通过实践来不断完善,已经是行业的大势所趋。

AI价值对齐,是当前阶段人工智能领域最具挑战性的基础研究项目之一,需要广泛的学科和社会参与,其研究价值,更是攸关下一阶段更强大的AI能否得以安全控制,实现AI向善的长远目标。腾讯研究院华东基地秘书长徐思彦介绍,腾讯研究院作为腾讯公司设立的智库机构,在上海设立了华东基地作为区域研究的交流平台,联合本地产学研各类机构,通过对话沙龙、课题研究和白皮书等方式,开展前沿科技、人工智能、未来城市、金融科技、工业互联网等多领域的研究。

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

新火种

2023-11-01

新火种

2023-11-01