AI强化的人性化多模态视觉辅助系统,上交大开发智能便捷的穿戴设备,登Nature

科技的发展目的是服务于人,故而高新技术的应用也应当以人为本。目前人工智能驱动的可穿戴电子系统没有充分考虑盲人的适应状况,导致采用率很低。

上海交通大学、上海人工智能实验室等开发了一种多模态可穿戴系统,通过融合软件和硬件创新来提高智能穿戴设备的可用性。在软件方面定制了专属 AI 算法用于匹配场景和人类行为需求;硬件方面开发了可拉伸的动感人造皮肤补充反馈。

中国上海交通大学的人工智能研究员 Leilei Gu 表示,这项系统可以部分取代眼睛,尽管目前的实验尚且停留在原型机阶段。

该研究以「Human-centred design and fabrication of a wearable multimodal visual assistance system」为题,于 2025 年 4 月 14 日刊登于《Nature》。

论文链接:https://www.nature.com/articles/s42256-025-01018-6

相关报道:https://www.nature.com/articles/d41586-025-01214-9

定制一双眼睛

为盲人开发人工视觉是医疗工作者长期以来的追求。可穿戴式设备通过将环境信息转换为其他感官模式并将其反馈到大脑从而补偿视力的缺失。

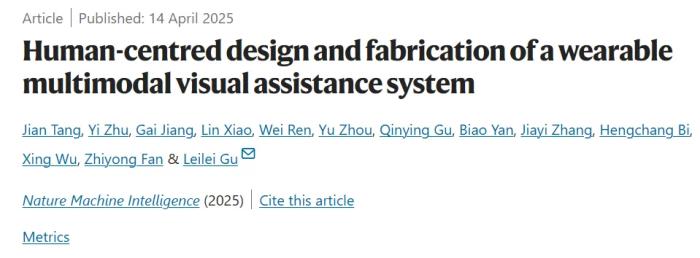

目前的系统在执行这类任务时还存在些困难,而全新的系统弥补了这点。通过语音输入控制方向,并利用 AI 算法处理设备摄像头传输的实时图像,保证佩戴者可以安全前进。

在低功耗计算单元上处理好的数据会被反馈到人机界面,移动目标检测算法 YoloV8n 会识别出关键对象。这在实验测试的数据集中表现出卓越的精度(自定义数据集调整后 0.82、预训练 0.59)。

除此之外,RGB 和红外图像的组合还保证了设备在环境光不足与运动模糊等现实问题考验下的发挥。嵌入式惯性测量单元(IMU)避免设备对模糊图像进行不准确的分析。

图 1:可穿戴多模态视觉辅助系统概述。(图源:论文)

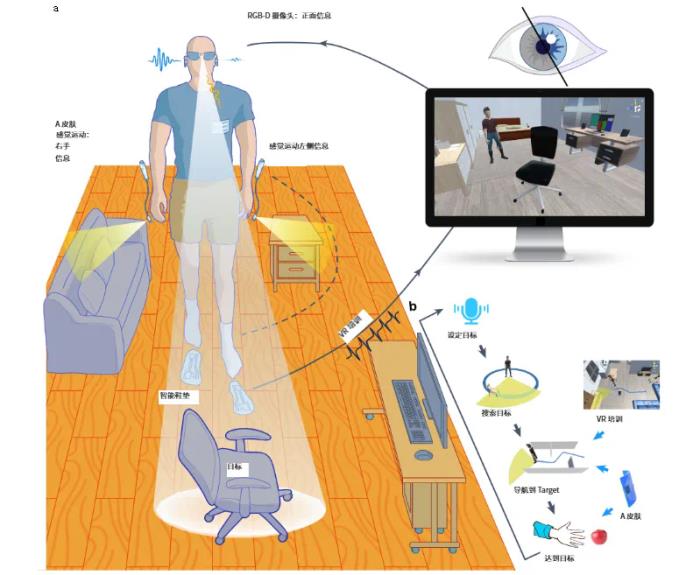

测试中,团队使用人形机器人演示系统的视觉功能,达成了在人工视觉的引导下接近苹果的目的。该序列突出了系统的实时视觉识别,为开发以用户为中心的辅助技术奠定了基础。

个性化视觉

为了能够准确检测各种障碍物,例如悬挂、地面和沉没障碍物,研究团队使用了两种方法——全局阈值与地面间隔相结合。

前者检查深度图像中的所有像素,深度在一定阈值区间内的像素被视为障碍物,避免了将地面纳入障碍的范畴;后者将无遮挡地面建模为沿深度图像垂直索引的单调递增函数,在各种条件下都能有效运行,仅需要仔细校准阈值高度。

图 2:避障演示。(图源:论文)

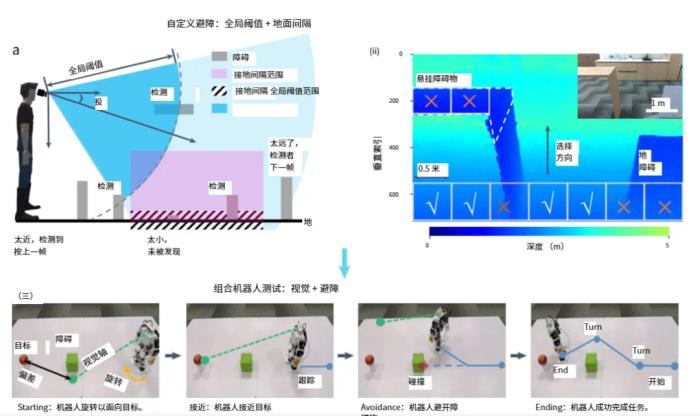

清晰直观的反馈信号有助于大脑轻松解释,从而降低认知负荷。但目前常依赖听觉传达高密度信息,故而目前采用生物相容性编码策略的设计来传达高级场景信息,以此缓解超负荷所带来的不适。

补充语音导航的不足

在导航的路上,仅有语音提示是不够的,相信读者在实际出行的过程中也没少被带入错误的道路,因语音提示不及时的原因也常会误入歧途。

对于没有视觉辅助的盲人群体,只有语音辅助显而易见并不足以满足他们的需要。所以,更加体贴的人造皮肤被专门设计出补充音频反馈。

图 3:人造皮肤运动感知系统。(图源:论文)

该系统的核心组件是一个紧凑的 time-of-Flight(ToF)传感器,当距离小于预定义的阈值时,致动器会振动以刺激皮肤。制动器设计纤薄,以求提高能源利用效率。

驱动器与皮肤保持的间距同时保证了执行器的震动与空气流通,变相减少了摩擦损耗。传感器位于手部,根据手指的不同动作切换对应的功能。

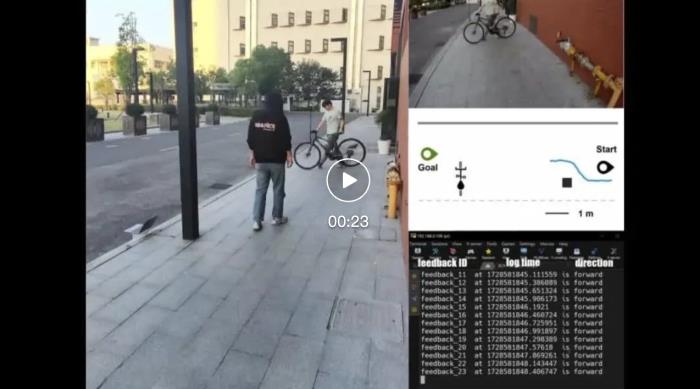

团队放出了实际测试视频,在演示中,所有参与者都能够在室内导航,他们的步行速度与使用手杖时相似。

在另一项试验里,8 名参与者在现实环境中测试该设备,包括在城市街道上行走和穿过摆满家具的会议室,这项技术在这些场景中均表现良好。

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

新火种

2025-04-18

新火种

2025-04-18