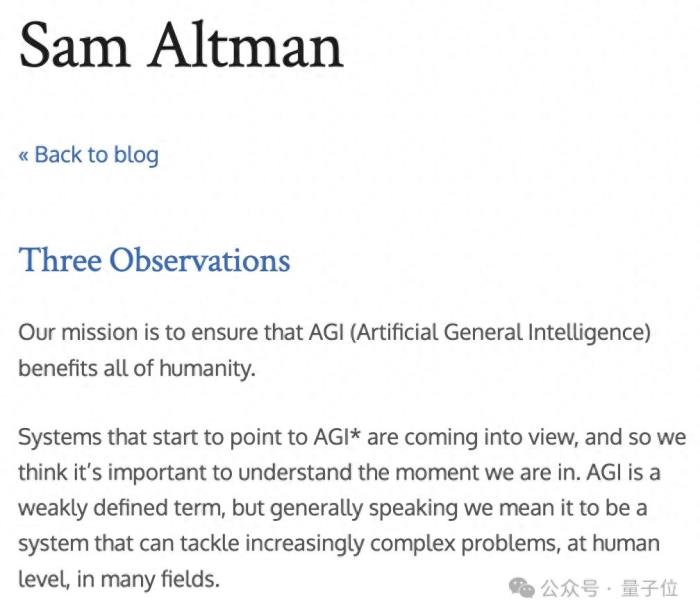

刚刚,奥特曼给出AGI三个判断:ScalingLaw保持不变,没理由放缓投资

刚刚,OpenAI奥特曼的最新AI观察出炉:

Scaling Law将保持不变,短时间内没有理由停止对AI进行指数增长级的投资!

具体共有3点

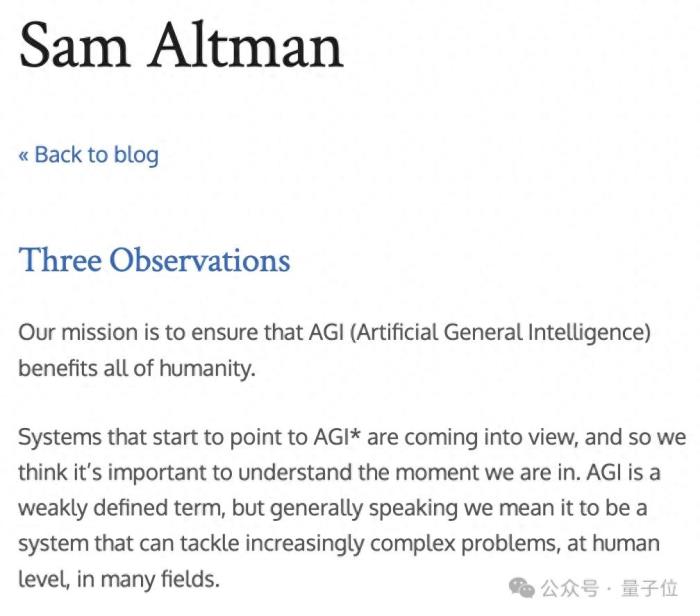

在最新发布的博客里,他给出对于AGI当下及未来的细致判断。

等到2035年,每个人都可以调动相当于2025年所有人智慧总和的能力。

但在2025年,世界还不会发生太显著的变化。

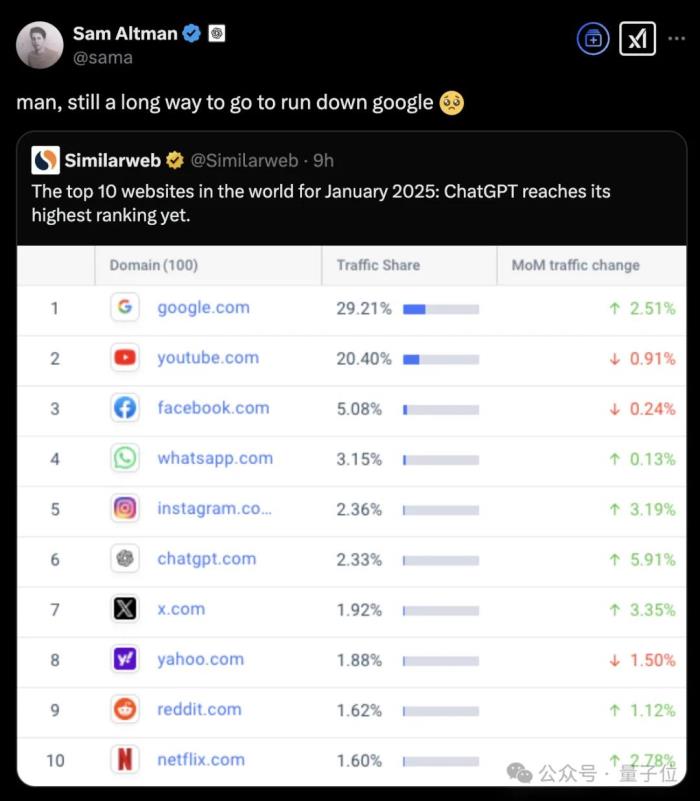

同时他还转发了2025年1月十大网站排名,其中ChatGPT达到史上最高排名(第六),但他表示超越谷歌还有很长的路要走。

或许言下之意是,等到ChatGPT超越谷歌了,那世界是不是就真的变了?

值得一提的是,奥特曼在博客中写道AGI应该是能够在许多领域以人类水平解决越来越复杂问题的系统。

然后在文章最后又来了一则声明:

此前据The Information爆料,2023年双方达成秘密协定——OpenAI需要研发出能够带来1000亿美元收益的AI系统,才能被视为实现AGI。

AI会像晶体管一样,充满世界每个角落具体来看,最核心的三点观察如下:

1、AI模型的智能水平大致等于其训练和运行所用资源的对数。

这些资源主要包括训练算力、数据和推理算力。看起来可以花费无限的资金,获得持续且可预测的增长;这种关系通过“扩展定律”在多个数量级上都得到了验证。

按照这一说法让AI总结公式大概长这样:I = k * log(R)

I 代表AI模型的智能水平 (Intelligence)R 代表投入的资源总量 (Resources),包括训练算力、数* 据和推理算力k 是一个比例常数2、使用AI的成本每12个月大约降低10倍。

而更低的价格会导致更广泛的使用。比如,从2023年初的GPT-4到2024年中的GPT-4o,单词的价格下降了大约150倍。这种变化速度远超摩尔定律(18个月翻倍)。

转换成公式模式后,或许长这样:C(t) = C₀ * (0.1)^(t/12)

C(t) 是t个月后的成本C₀ 是初始成本(t=0时的成本)t 是经过的月数举例说明:

t=36时,成本为C₀ * 0.001(降为初始成本的1/1000)即3年后,使用AI的成本会变成如今的1/1000。

3、随着智能水平线性增长,其社会经济价值呈超级指数型增长。因此,我们看不到未来几年内停止指数增长投资的理由。

奥特曼表示,如果这些观察持续成立,AI对社会的影响将是巨大的。

AI Agent无处不在抽象推论之下,具象的变化是什么?

奥特曼再次提到AI Agent。

他表示Agent最终会像虚拟同时一样与人类协作。

想象有一个软件工程Agent,它完成大多数顶尖公司中有几年经验的工程师能够完成的任务,工作时长可达几天。

在这之中,最大的创新点不会来自AI。整个过程仍旧需要大量的人类监督和指导。

想象一下,如果有1000个、10000个、甚至100万个这样相对初级的虚拟同事。然后再让这样的Agent拓展到各个工作领域。

20世纪中期,随着晶体管这项突破性发明诞生,计算机、手机等现代电子设备才得以被创造。它的突破不仅在于技术本身,更在于它能够大规模生产,应用到几乎所有领域(从家电到航天)。

现在,普通人很少直接意识到晶体管的存在,但它几乎驱动了所有现代技术。

在奥特曼的判断里,或许未来AI也将几乎嵌入到所有行业和设备中,无处不在。但是人类可能也不会直接谈论AI,而是默认它是生活和工作的“背景技术”,无处不在但又不被特意提起。

巨变不在现在不过回归当下,奥特曼表示,短期内我们的生活大致保持不变。

但未来将以一种不可忽视的方式向我们袭来,对社会和经济的长期影响将是巨大的。我们会找到新的事情去做,探索新的方式去彼此帮助和竞争,这些新形式可能和今天的工作方式大不相同。

自主性、意志力和决心将变得尤为重要。能够正确决定做什么,以及如何在不断变化的世界中导航,将变得非常有价值;韧性和适应能力将成为需要培养的关键技能。AGI将是对人类意志的最大助力,赋予个体前所未有的影响力,而不是削弱它。

AGI不均衡的影响AGI的影响将是不均匀的。有些行业可能变化不大,但科学进步的速度可能比今天快得多,这一影响或许超越其他一切。

许多商品的价格最终会大幅下降(目前,智能和能源成本限制了许多事物),而稀缺资源的价格可能显著上升。

技术路径看起来相对清晰,但公众政策和集体意见对如何将AGI融入社会非常重要。我们提前推出产品的一个原因,就是为了让社会和技术有时间共同进化。

2035年更值得期待最后,奥特曼还是给了个时间坐标参考,10年后的2035。

历史表明,技术进步通常会改善健康和经济等指标,但不一定会自然增加平等,因此可能需要新的想法来实现这一目标。

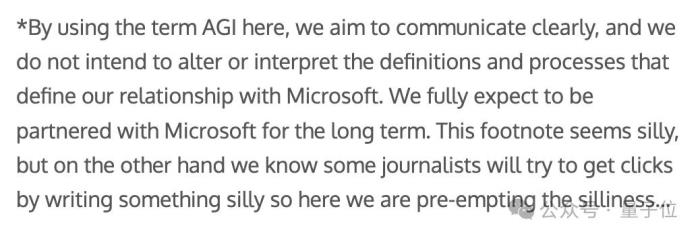

网友:这不自相矛盾吗?尽管奥特曼洋洋洒洒这么多篇幅去详细阐述AGI。

但网友们最关心的点却是最后的脚注。

大概就是,这篇博客中将AGI定义为能够在许多领域以人类水平解决越来越复杂问题的系统。

这个定义与之前OpenAI微软定义的AGI不冲突,后者是——

这有点滑稽了。

网友总结:基本上,“我们无意坚守不将 AGI 商业化的承诺。事实上,我们会把它商业化”。

还有人调侃了成本下降的问题。

所以,你怎么看奥特曼的最新观察呢?

参考链接:https://blog.samaltman.com/three-observations

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

新火种

2025-02-12

新火种

2025-02-12