OpenAI把GPT-4原始版给了他们:研究不微调只靠提示词能走多远

除了OpenAI自己,居然还有别人能用上GPT-4-Base版??

也就是未经微调的预训练版,还不会对话聊天,只会补全句子的模型。

EPFL(瑞士洛桑联邦理工)团队申请到了访问权限,用于研究“上下文学习足以让大模型跟随指令吗?”。

也就是不用监督微调、也不用RHLF或其他强化学习对齐方法,只靠提示词能走多远?

预训练模型,究竟能不能一步登天,直接改造成聊天机器人或AI助手?

如果可行,将大大降低类ChatGPT大模型的开发难度。

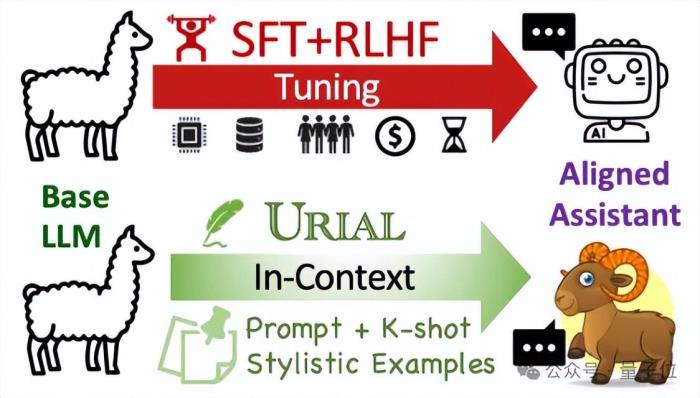

免微调对齐,让刚出炉的预训练模型不止会“文本补全”,只从提示词中学会和用户对话、跟随指令,一直是业界关注的研究方向。

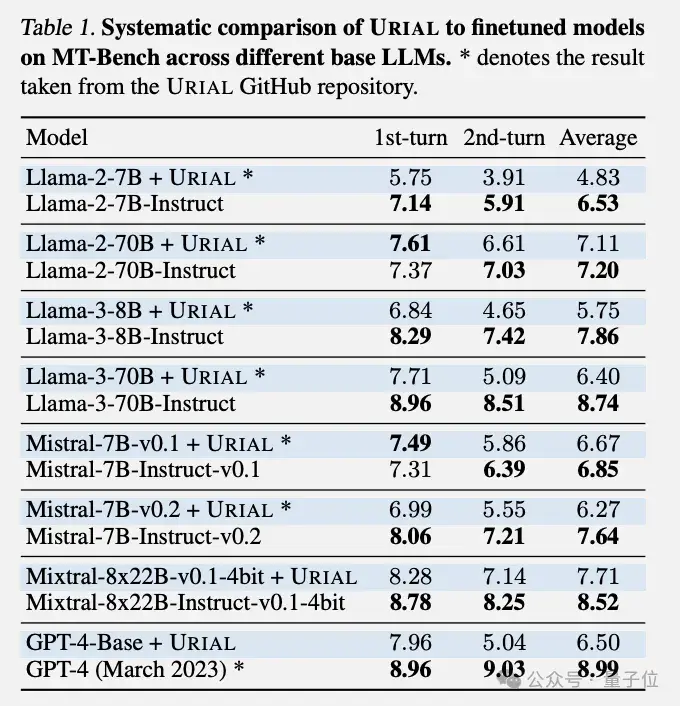

目前的SOTA方法URIAL来自艾伦研究所,使用系统提示词+少数风格示例就能达到不错的效果。

但EPFL团队发现,URIAL仍无法完全弥补与指令微调模型的差距,尤其在多轮对话中的表现更差一些。

实验中,在Llama系列、Mistral系列和一般人接触不到的GPT-4-Base都观察到这种现象。

其中GPT-4-Base的API访问权限从OpenAI Researcher Access Program项目中申请到。

EPFL团队从这里出发,尝试了各种办法来提升上下文学习的效果。

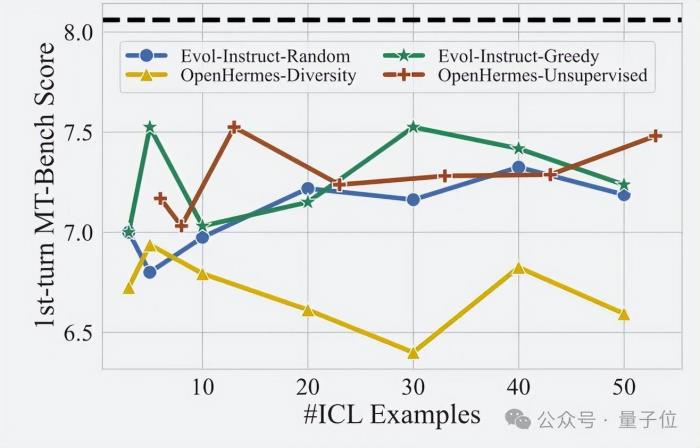

首先他们增加示例的数量,但发现帮助不大,没有随着例子数目增加性能就提升的趋势。这一点跟图像分类、机器翻译等任务还不太一样。

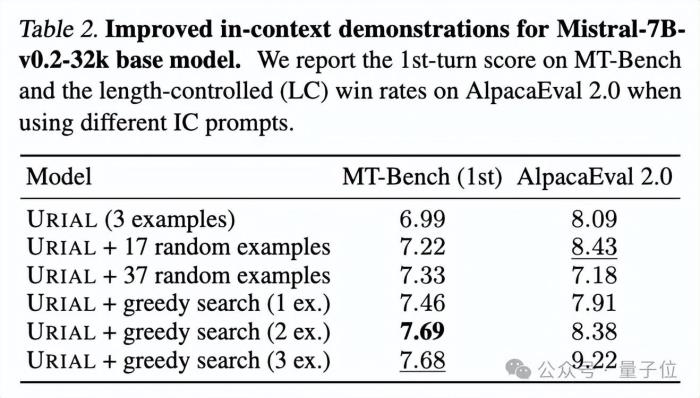

然后他们使用了贪心搜索算法,从一大堆示例中选择最佳的添加到上下文。

这种方法可以进一步提高性能,但与指令微调模型的差距仍然存在,特别是在 AlpacaEval 2.0基准测试中。

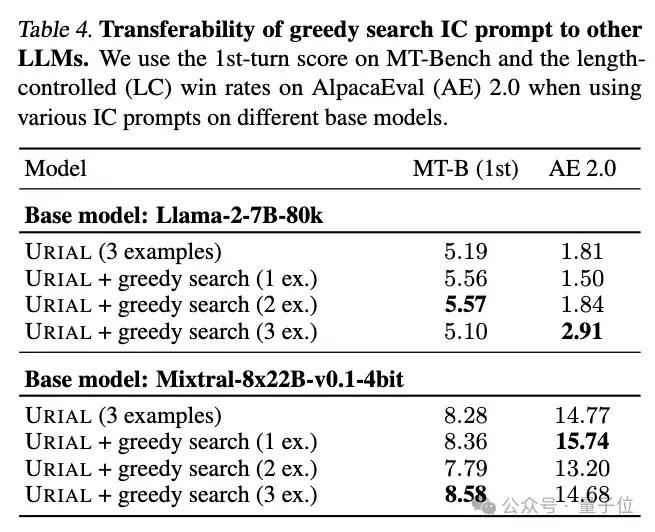

此外他们还发现,贪心搜索为某个特定模型找到的最佳示例,对于其他模型不能可靠地迁移。

也就是说,不同的示例适合不同的模型。

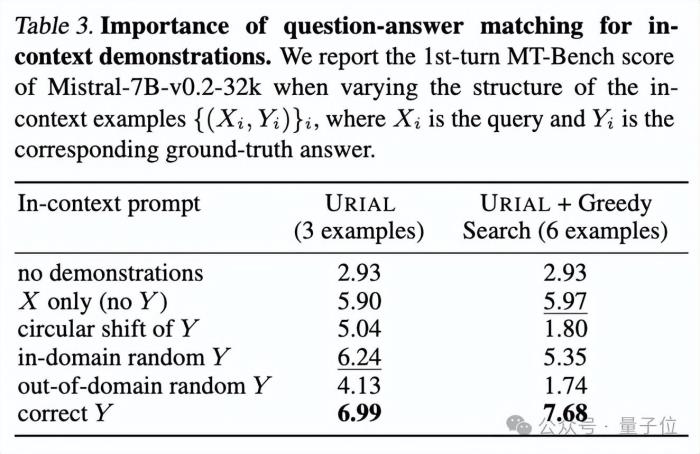

团队还进行了一系列消融实验,以更多地了解上下文学习的工作原理。

他们发现,在MT-Bench这样的综合评测中,示例包含正确的“问题-答案对”至关重要。

这与此前大模型在分类任务中,只要有大量示例,部分标签错了也无所谓的发现非常不同。

所以最终得出的结论是:

论文最后分析,大语言模型可能通过上下文学习只学会了如何模仿例子里的回答风格,但还没有真正理解执行指令的逻辑。

指令跟随任务相对还是比较复杂和开放的,没那么容易掌握。

想让AI助手更“听话”,暂时还是很难有捷径可走。

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

热门文章

新火种

2024-06-04

新火种

2024-06-04