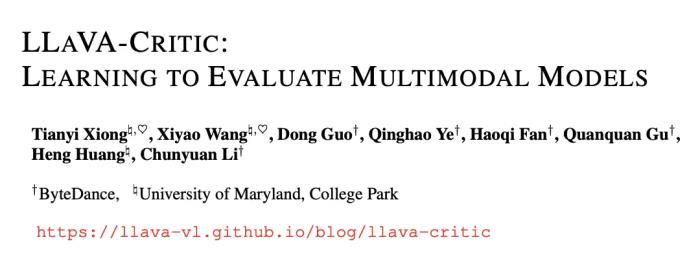

EvaluationisAllYouNeed!首个开源多模态大模型通用评测器LLaVA-Critic

作者介绍:本文作者来自于字节跳动和马里兰大学。其中第一作者为马里兰大学博士生熊天翼,主要研究领域为计算机视觉,多模态基础大模型;通讯作者为 Chunyuan Li (https://chunyuan.li/)。本文作者也包括马里兰大学博士生王玺尧,字节跳动研究员 Dong Guo、Qinghao Ye、Haoqi Fan、Quanquan Gu, 马里兰大学教授 Heng Huang。引言:Evaluation is All You Need随着对现有互联网数据的预训练逐渐成熟,研究的探索空间正由预训练转向后期训练(Post-training),OpenAI o1 的发布正彰显了这一点。而 Post-training 的核心在于评测(Evaluation)。可靠的 AI 评测不仅能在复杂任务的评测中提供可扩展的解决方案,减少人工劳动,还能在强化学习中生成有效的奖励信号并指导推理过程。例如,一个 AI 评测器可以遵循用户设计的评分标准,在视觉对话任务中为不同模型的回复(model response)提供 1 到 10 的评分。除了评分外,它还会提供相应的给分理由,确保模型性能评测的透明性和一致性。来自字节跳动和马里兰大学的研究团队发布了首个用于多任务评测的开源多模态大模型 LLaVA-Critic,旨在启发社区开发通用大模型评测器(generalist evaluator)。

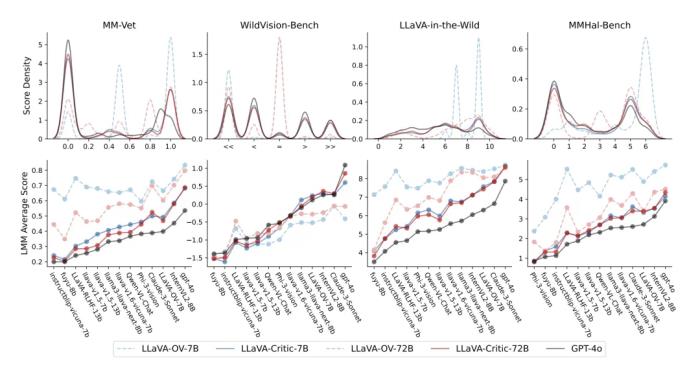

在评分的整体分布和对回复模型 (response model) 的排序层面上,LLaVA-Critic 均展现了与 GPT-4o 的一致性

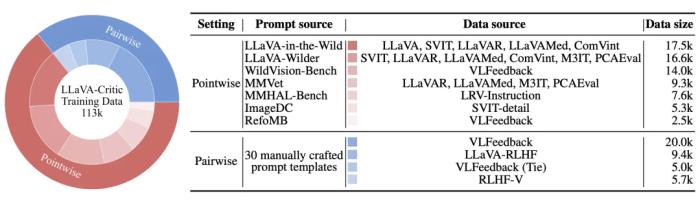

如上图所示,在单点评分的评估任务中,LLaVA-Critic 大幅超越其基础模型 LLaVA-OneVision—— 在多个开放式问答评估基准上,其评分一致性和模型排序与 GPT-4o 高度吻合。

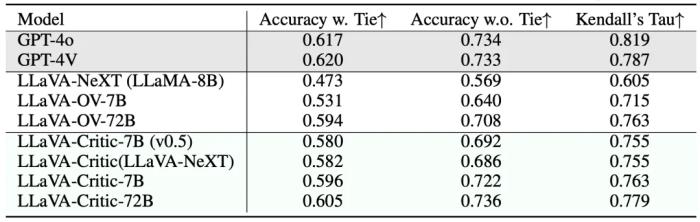

上表展示了 LLaVA-Critic 在 MLLM-as-a-Judge 基准测试中的表现,该测试包括了训练数据中未见过的更广泛评测场景。面对全新的评测任务,LLaVA-Critic 也显著缩小了开源模型与 GPT-4o/4V 在评测准确性上的差距,充分展现其泛化性与通用性。在上述实验结果中,72B 模型的表现优于 7B 模型,Critic-7B 的表现也优于使用弱化版本评测数据训练的 Critic-7B(v0.5)—— 这进一步强调了模型扩展(model scaling)和数据扩展(data scaling)在构建通用评测器中的重要性。

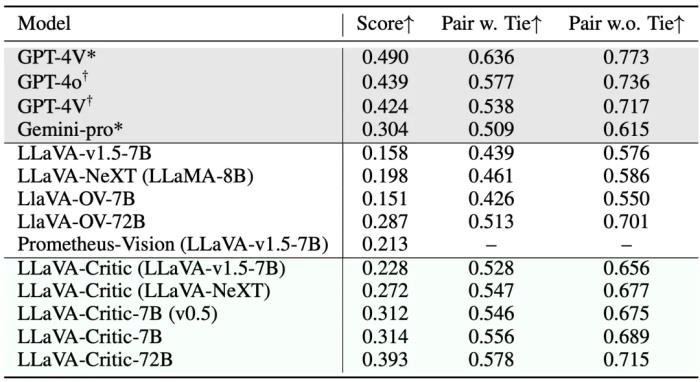

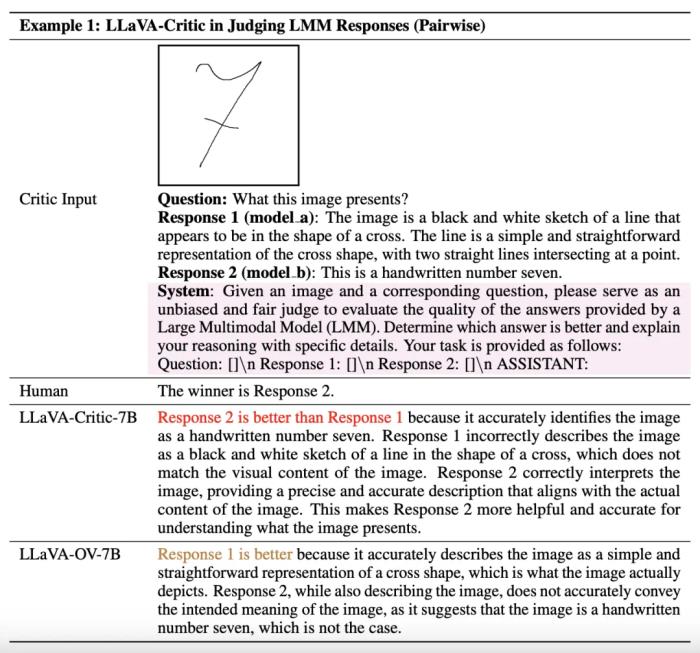

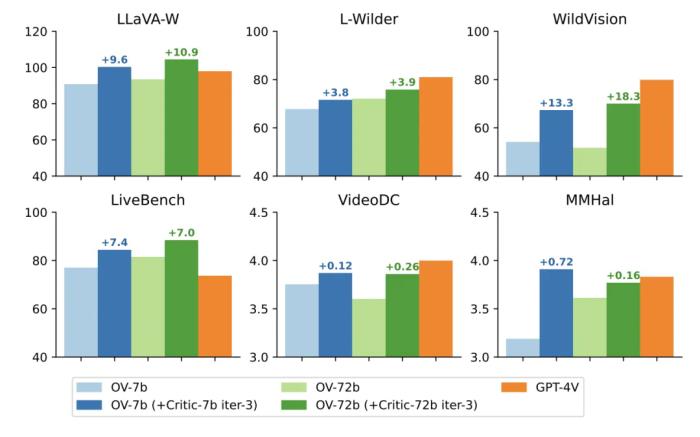

在这个成对排序示例中,LLaVA-Critic 能够准确识别输入图像的内容(手写数字 「7」),并基于回复间的差异做出判断,给出了和人类评估者一致的排序,并提供了清晰的理由说明。后者(评分理由)对于构建可靠人工智能至关重要,它使 LLaVA-Critic 的评测过程更透明,评测结果更可信。场景二:偏好学习(Preference Learning)LLaVA-Critic 的评测能力也可用于比较成对模型回复的好坏,从而作为奖励信号应用于 RLHF 和 DPO 等强化学习算法。实验中,该团队将 LLaVA-Critic 用于迭代直接偏好优化( iterative DPO)算法,具体方式如下:给定一个预训练 LMM 和一组图片 - 问题输入,首先让 LMM 对每一个图片 - 问题输入随机生成 K=5 个候选回复,由此构建出 Kx (K-1)=20 个成对回复。接着,使用 LLaVA-Critic 对这 20 个回复对进行成对排序,选出最好和最坏的回复,形成成对的反馈数据集。之后,使用这一数据集对于预训练 LMM 进行直接偏好优化(DPO)训练。在此基础上,渐进式迭代这一过程共计 M 轮,每次使用最新训练的模型生成候选回复,最终得到与 LLaVA-Critic 反馈对齐的模型。该团队采用 LLaVA-OneVision 作为初始 LMM,进行 3 轮 iterative DPO 训练,最终将训练后的模型命名为 LLaVA-OneVision-Chat。随后,他们在多个开放式问答评测基准上测试了最终模型的表现,以比较 LLaVA-Critic 和其他奖励模型的效果。如上表所示,无论是在 7B 还是 72B 基础模型上,LLaVA-Critic(AI 反馈)均超越了 LLaVA-RLHF (人类反馈),显著提升了基础模型在 6 个多模态开放式问答评测基准上的表现。下方的柱状图进一步直观展示了 LLaVA-Critic 的反馈对 LLaVA-OneVision 模型在视觉问答性能上的提升效果。可见,LLaVA-Critic 作为一种提供有效奖励信号的可扩展方案,不仅减少了对昂贵人工反馈的依赖,还通过 AI 生成的反馈进一步优化了模型的偏好对齐效果。

结论LLaVA-Critic 是首个通用的开源多模态大模型评测器,能够在多个开放式多模态场景中评测模型表现。为实现这一目标,研究团队精心构建了一个高质量的评测指令遵循数据集,涵盖多样化的评测任务与标准。实验中展示了 LLaVA-Critic 在两个关键领域的有效性:1.作为通用的评测器,LLaVA-Critic 能够为需要评测的模型回复提供单点评分和成对排序,这些评分和排序与人类和 GPT-4o 的偏好高度一致,为自动评测多模态大模型的开放式回复提供了一个可行的开源替代方案。2. 在偏好学习方面,LLaVA-Critic 提供的偏好信号能有效提升多模态大模型的视觉对话能力,甚至超越了基于人类反馈的 LLaVA-RLHF 奖励模型。这项工作在利用开源多模态大模型自身的评价能力方面,迈出了重要的一步。我们期待更多的研究可以由此出发,通过探究更具可扩展性的,超越人类的对齐反馈机制,进一步推动多模态大模型的发展。

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

新火种

2024-11-15

新火种

2024-11-15