通用端到端OCR模型开源,拒绝多模态大模型降维打击

在AI-2.0时代,OCR模型的研究难道到头了吗!?(OCR:一种将图像中的文字转换为可编辑和可搜索文本的技术)

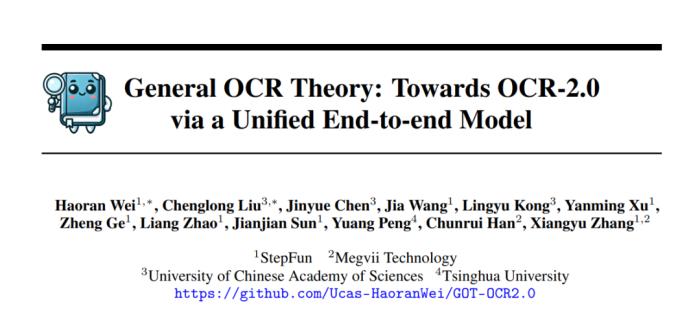

Vary作者团队开源了第一个迈向OCR-2.0的通用端到端模型GOT。

用实验结果向人们证明:No~No~No~

GOT模型效果如何?

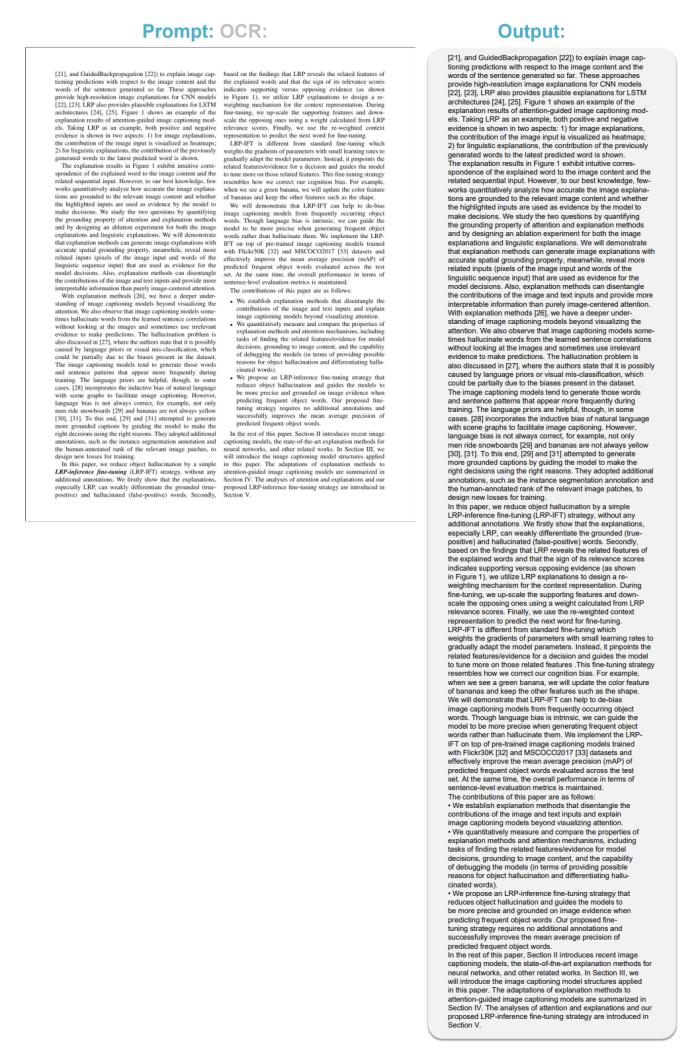

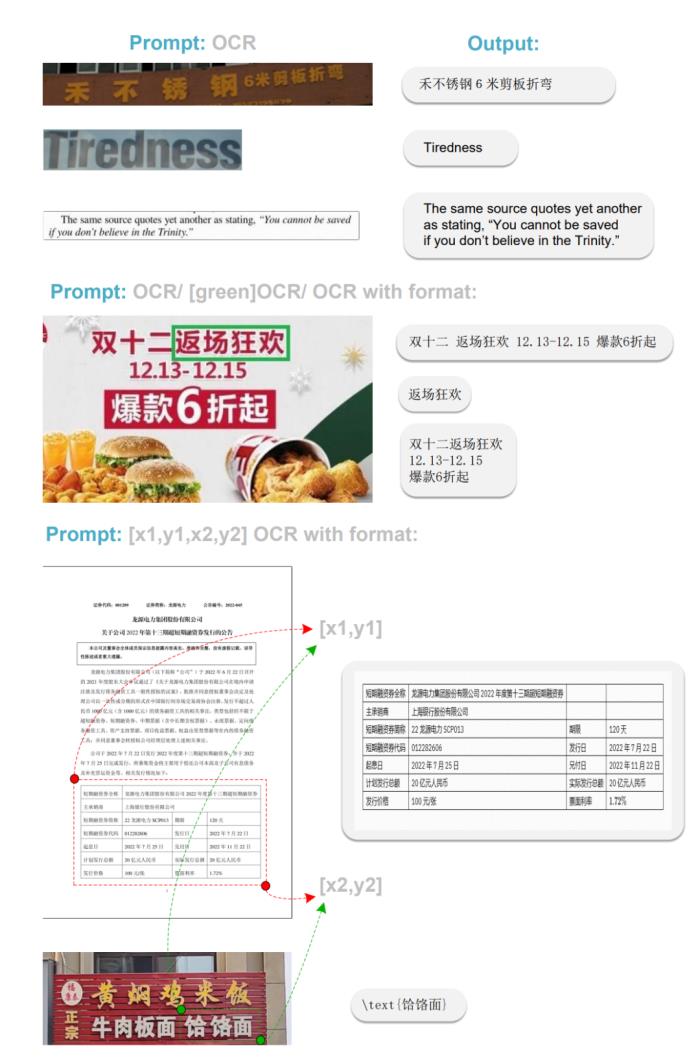

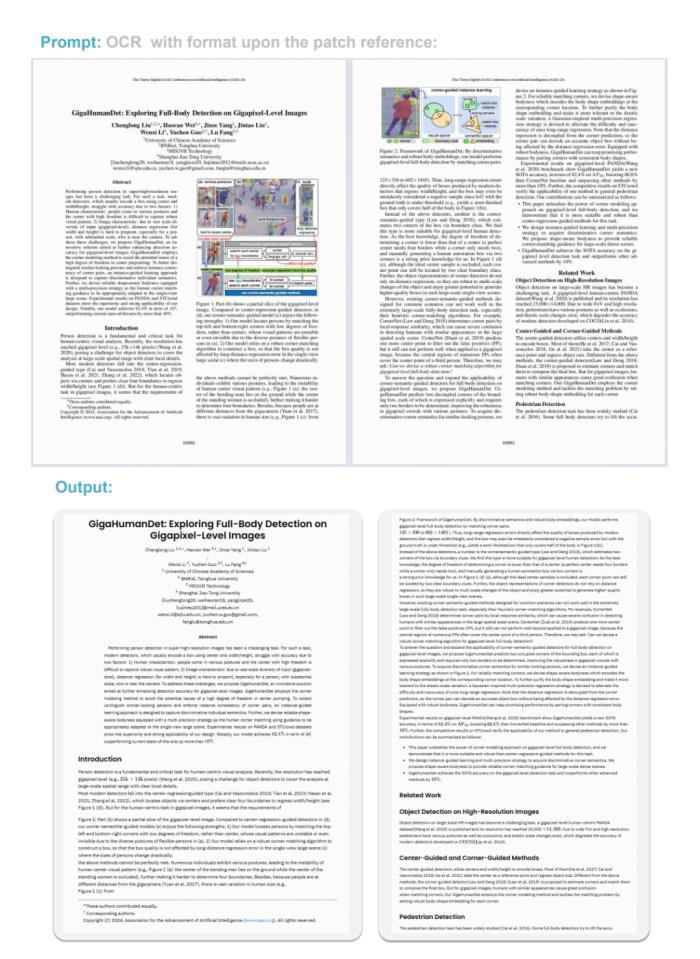

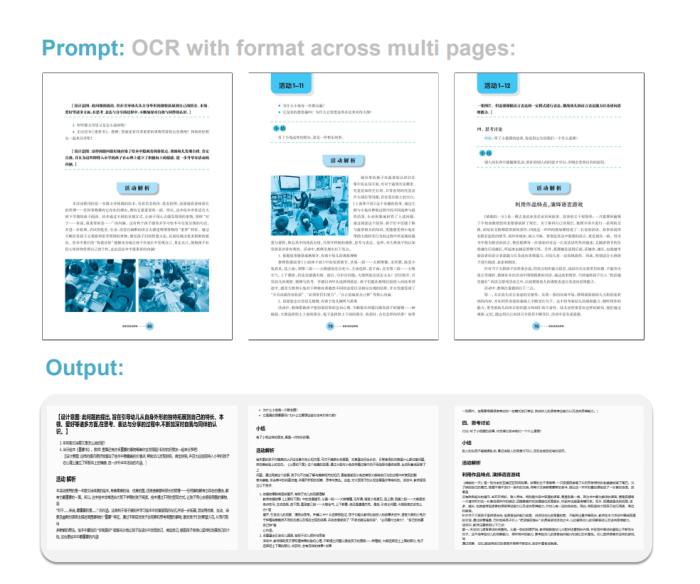

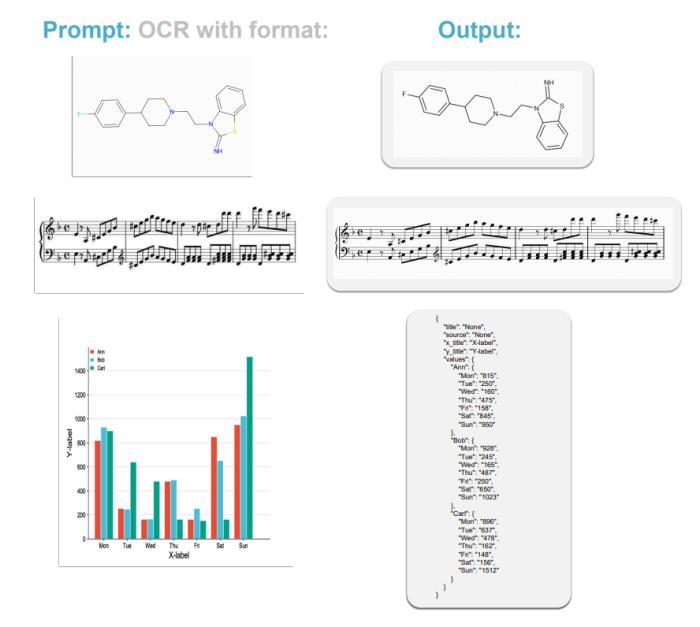

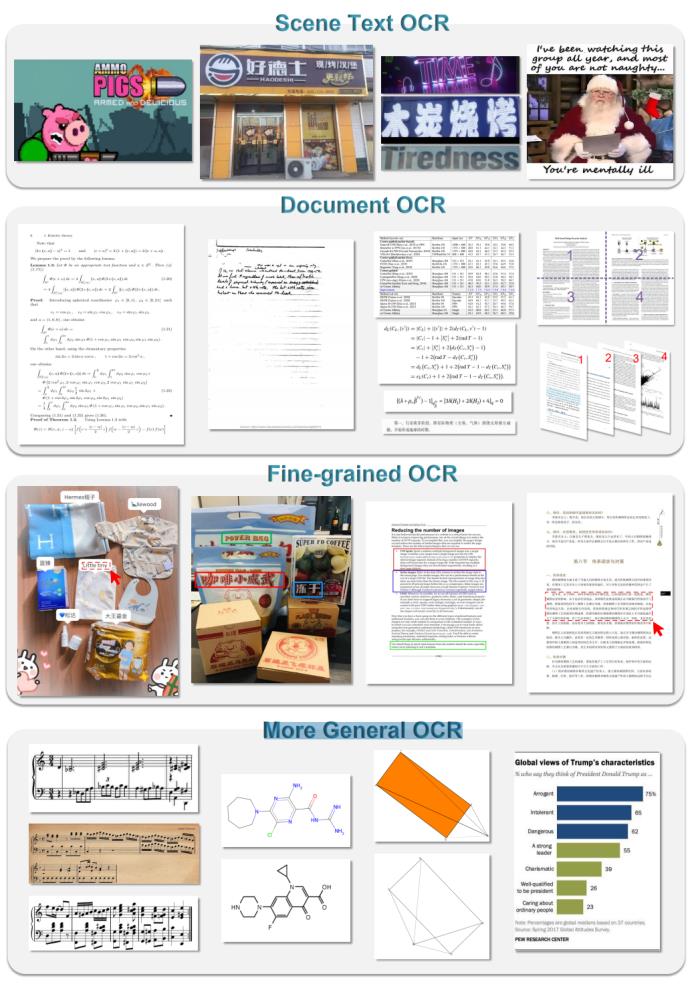

GOT模型效果如何?话不多说,直接上效果图:

△ 最常用的PDF image转markdown能力

△ 最常用的PDF image转markdown能力 △ 双栏文本感知能力

△ 双栏文本感知能力 △ 自然场景以及细粒度OCR能力

△ 自然场景以及细粒度OCR能力 △ 动态分辨率OCR能力

△ 动态分辨率OCR能力 △ 多页OCR能力

△ 多页OCR能力 △ 更多符号的OCR能力

△ 更多符号的OCR能力研究团队称,尽管GOT模型表现不错,但也存在一些局限,如更多的语言支持,更复杂的几何图,chart上的OCR性能。

他们说OCR-2.0的研究还远的很,GOT也还有不小提升空间(该项目在数据和算力资源上都是非常受限的)。

GOT: Towards OCR-2.0通用OCR模型须要够通用,体现在输入输出都要通用上。

GOT的通用具体表现为:在输入方面,模型支持Scene Text OCR、Document OCR、Fine-grained OCR、More General OCR等任务。

△ 通用OCR模型须“通用”

△ 通用OCR模型须“通用”输出方面,模型同时支持plain texts输出以及可读性强、可编辑的formatted文本输出,如markdown等。

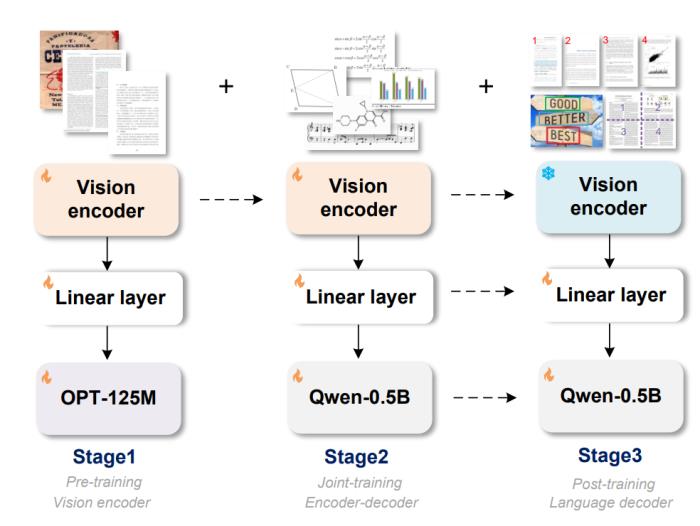

模型的结构和训练方法,采用vision encoder+input embedding layer+decoder的pipeline。

Encoder主体采用带local attention的VITDet架构,不会让CLIP方案的全程global attention在高分辨率下激活太大,炸显存。

Encoder后两层采用Vary的双卷积设计方案。整个Encoder将1024×1024×3的图像压缩为256×1024的image tokens,足以做好A4纸级别的dense OCR。

△ GOT结构与训练流程图

△ GOT结构与训练流程图研究团队将整个训练过程分为三个步骤,没有一个阶段锁LLM,过程中没有存在图像到文本的对齐阶段,进而导致损害image token的文字压缩率。

三个训练阶段分别为:

第一阶段:高效预训练encoder,GOT在整个训练过程中,没有A100级别的卡,为了节省资源,该阶段使用小型OPT-125M作为decoder为encoder提供优化方向,快速灌入大量数据。

第二阶段:联合训练encoder-decoder,该阶段GOT的基本结构搭建完成,为上一阶段预训练好的encoder,以及Qwen团队预训练好的Qwen0.5B。

研究团队稍稍加大了decoder的大小,因为该阶段需要喂入大量OCR-2.0的知识,而不少数据(如化学式的OCR)其实也是带点reasoning的,不过更小的decoder他们未敢尝试。

第三阶段:锁住encoder,加强decoder以适配更多的OCR应用场景,如支持坐标或者颜色引导的细粒度OCR(点读笔可能会用到),支持动态分辨率OCR技术(超大分辨率图可能会用到),多页OCR技术。

面对整个GOT模型设计中最困难的数据工程环节。研究团队为了构造各种各样的数据,还学习了众多数据渲染工具,包括Latex,Mathpix-markdown-it,Matplotlib,Tikz,Verovio, Pyecharts等等。

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

热门文章

新火种

2024-09-11

新火种

2024-09-11