周鸿祎谈Sora视频模型:中美的AI差距还在加大

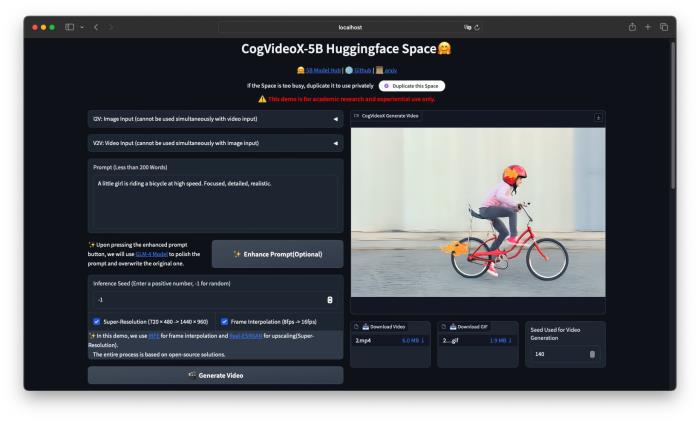

2月17日消息,OpenAI近日发布首款文生视频模型——Sora模型,完美继承DALL·E 3的画质和遵循指令能力其支持用户输入文本描述,生成一段长达1分钟的高清流畅视频。

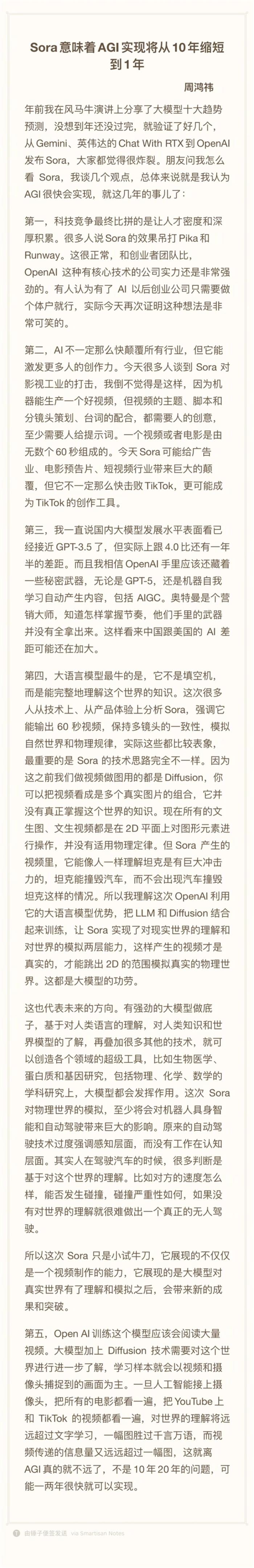

360董事长周鸿祎日前在微博发文,谈到OpenAI的文字转视频模型Sora,他认为Sora模型意味着 AGI实现将从10年缩短到1年。

周鸿祎称,AI不一定那么快颠覆所有行业,但它能激发更多人的创作力。

一个视频或者电影是由无数个60秒组成的,今天Sora可能给广告业、电影预告片、短视频行业带来巨大的颠覆,但它不一定那么快击败TikTok,更可能成为TikTok的创作工具。

周鸿祎还指出,国内大模型发展水平表面看已经接近GPT-3.5了,但实际,上跟4.0比还有一年半的差距。

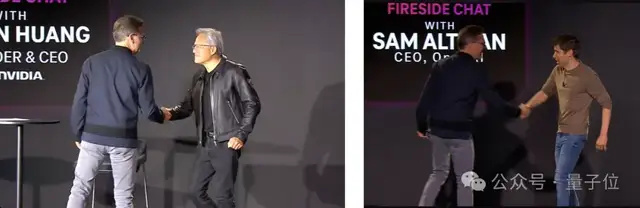

OpenAl手里应该还藏着一些秘密武器,无论是GPT-5,还是机器自我学习自动产生内容,包括AIGC。

奥特曼是个营销大师,知道怎样掌握节奏,他们手里的武器并没有全拿出来,这样看来中国跟美国的Al差距可能还在加大。

此外,Open AI训练这个模型应该会阅读大量视频,大模型加上Diffusion技术需要对这个世界进行进一步了解,学习样本就会以视频和摄像头捕捉到的画面为主。

一旦人工 智能接上摄像头,把所有的电影都看一遍,把YouTube,上和TikTok 的视频都看一遍,对世界的理解将远远超过文字学习。

一幅图胜过千言万语,而视频传递的信息量又远远超过一幅图,这就离AGI真的就不远了,不是10年20年的问题,可能一两年很快就可以实现。

相关推荐

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

新火种

2024-02-21

新火种

2024-02-21