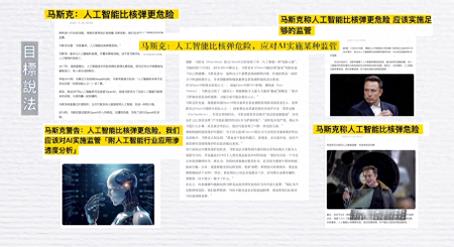

马斯克说人工智能比核弹更危险?监管法案有什么规定?

最近当比尔·盖茨等互联网大佬都在欢呼,AI技术将开启下一个互联网时代的时候,马斯克却说人工智能比核弹更危险,这是怎么回事呢?

马斯克曾对自己的自传作者说,我想了想什么东西能真正影响人类社会,想起来三个:互联网、可持续能源和太空旅行。所以我们发现与他有关联的公司都围绕着这三个领域,其中包括大名鼎鼎的OpenAI公司,OpenAI这个名字也是马斯克起的。

我们将相关关键词在全网进行检索,发现有多家媒体报道称,在2023年11月举行的DealBook峰会上,马斯克曾公开提到,在他看来人工智能比核弹更危险,并且应该对人工智能实施某种监管。

马斯克为什么一边共同创立了最著名的OpenAI,一边又形容人工智能是危险的事物,甚至作为研发方主动要求相关部门进行监管。那么马斯克对人工智能究竟是一种什么态度?

公开资料显示,DealBook峰会2011年由《纽约时报》专栏作家安德鲁·索金主持创办,峰会主要邀请全球具有影响力的政治企业以及文化领袖与精英分享经验及观点。在YouTube上的《纽约时报》子账号“纽约时报活动”中可以看到,在对马斯克采访的视频中,访谈进行到大约60分钟时,马斯克提到了了人工智能安全性的问题,他解释了当初创立OpenAI的初衷,正是基于自己对于人工智能安全性的担忧。

在人工智能安全性的问题上,谷歌创立人拉里·佩奇和马斯克的看法并不相同。12月7日《纽约时报》科技版块发表了一篇文章,内容主要讲述的是硅谷的AI争夺之战是如何被点燃的。这篇文章开篇就展示了一张图片,画中的人物正是拉里·佩奇和马斯克,再现的场景是2015年在马斯克生日派对上,当着众多宾客的面,两人针锋相对地就人工智能展开了激烈的辩论,最新出版的《马斯克传》也对这场辩论进行了一个段落的描写。文章和自传都描写到关于对待人工智能,马斯克坚持是要建立防火墙,不能让人工智能取代人类,那样的话人类将会灭亡,而拉里·佩奇则认为人类最终将与人工智能机器融合,这只不过是进化的下一个阶段。

拉里·佩奇收购的DeepMind和马斯克创立的OpenAI,或许大家不是很熟悉,但是一定使用或者听说过他们各自生产研发的人工智能产品。2016年3月,人工智能程序AlphaGo击败了世界围棋冠军李世石,全球当时有2亿人观看了那场在互联网上直播的比赛,AlphaGo正是由DeepMind公司开发的。而大名鼎鼎的聊天机器人ChatGPT则是由OpenAI于2022年底发布的,只不过那个时候马斯克因为公司控制权的问题,已经离开OpenAI四年了,后续的投资方变成了微软公司,由非盈利转为盈利模式。虽然创立之初,两家公司对于人工智能持截然不同的态度,但是客观上他们都促进了人工智能的发展,尤其是OpenAI,有数据表明每周有1亿人在使用这个人工智能的模型,充分展现了人工智能的潜力和风险。

马斯克抛出人工智能比核弹更危险这一言论的目的,是要求对人工智能进行监管。这让我们想起今年3月14日GPT-4发布之后不久,马斯克就和其他1000多名科技界领袖与研究人员呼吁暂停开发比GPT-4更强大的AI系统。他们在公开信当中说,AI开发人员陷入了一场失控的竞赛,开发和部署越来越强大的数字思维,以至于所有人甚至包括它们的创造者,也无法理解、预测或可靠地控制它们。暂停开发将为人工智能系统引入共享安全协议提供时间。如果无法快速实施这样的暂停,政府应该介入并制定暂停期。然而事件后来的发展是,人工智能的开发并没有按下暂停键,但是马斯克等人的呼吁也并非没有得到回应。

2023年10月30日,美国总统拜登在白宫签署人工智能监管行政令,这份名为《安全、可靠和可信赖的开发和使用人工智能》的行政命令包含多项要求,其中包括美国最强人工智能系统的研发人员,需与政府分享其安全测试结果及其他关键信息,制定严密的合成生物检查新标准,防范使用人工智能设计危险生物材料的风险等多方面的要求。

马斯克强调自己是

蒋南頔(中国执业律师):“此前美国对于人工智能的监管更多是停留在讨论和舆论层面,一方面此前人工智能技术尚未发展到需要法规进行规制的一个时期,而对于发展初期的新技术政策层面一般会采取较为宽松的态度,以避免过于严格的制度规范阻碍技术的发展。那另一方面,各方利益还在冲突和博弈,而今年作为通用人工智能的元年,以ChatGPT为代表的深层次人工智能模型,开启了通用人工智能模型的新时代,人工智能带来的希望和风险更为真切地进入人们的视野,其发展速度也使得政策制定者们更真切地感受到了制定相应规则制度的一个迫切性。”

就在美国发布一系列举措后,布鲁塞尔当地时间12月8日,欧洲议会欧盟委员会和27个成员国代表经过30多个小时的谈判后,就《人工智能法案》达成协议,该法案被视为全球首部AI领域的全面监管法规。如果欧盟成员国和议会正式批准,预计将在2024年初生效,两年后全面实施。与美国的监管行政令相比,欧盟的这项法案看上去是更加严格和详细了。

综合多方报道,《人工智能法案》按照不同的风险类别为人工智能技术应用进行了分类,通过识别不同风险来进行监管,严格禁止对人类安全造成不同风险的人工智能系统。其中包括有目的地操纵技术,利用人性弱点或根据社会行为和个人特征进行评价的系统等。人工智能公司要对其算法进行人为控制,提供技术文件,并为高风险应用建立风险管理系统。每个欧盟成员国都将设立一个监管机构,确保这些规则得到遵守。生成式人工智能也就是包含ChatGPT在内的模型,也需要遵守新的透明度要求。

早在2023年7月,中国国家网信办联合国家发改委等多个部门正式发布《生成式人工智能服务管理暂行办法》,从8月15日起实施。办法要求生成式人工智能服务提供者采取有效措施,提高训练数据质量,增强训练数据的真实性、准确性、客观性、多样性,也明确了监管的基本原则,即对生成式人工智能服务实行包容审慎和分类分级监管。

从中外来看,人工智能的监管已经成为全世界共同的课题,但是监管的目标却是一致的,那就是让人工智能技术健康发展。当然各国也希望自己能在这场革命性的技术竞争当中处于优势地位。

有网友称,马斯克在抛出人工智能比核弹还危险这句话之后还解释说,虽然目前美国的人工智能技术处于领先地位,但是不能掉以轻心,因为中国的人工智能技术正在赶超,美国的人工智能只能领先12个月而已。马斯克真的这样说过吗?

以关键词进行全网搜索后,我们发现马斯克关于中美人工智能相差大概12个月的说法,来自于2023年5月的一段视频采访。

制作人:梁茵

本期编导:张恒

文字

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

新火种

2024-01-02

新火种

2024-01-02