观察|生成式AI技术迅猛发展,我们应该如何去伪存真?

11月初,一则“日本首相岸田文雄”出镜的视频在YouTube等社交平台上传播甚广。在该视频中,“岸田文雄”发言内容相当低俗。该视频下方还有“突发新闻”字样,右上角有日本电视台的台标与直播等字样。

值得注意的是,在该视频中,“岸田文雄”表情呆滞,说话时脸部也只有鼻子以下的部分有动作,上述奇怪的细节不禁令人怀疑该视频的真伪。

在该视频在社交平台上引发多方关注后,制作该视频的不具名男子在社交平台X(原推特)上承认讲不雅段子的“岸田文雄”是自己通过生成式AI合成的,并对此道歉。

该男子称,自己让AI软件先学习了网上公开的岸田讲话的声音,然后把自己读“黄段子”的声音转换成与岸田高度相似的声音,并在网上检索日本电视台新闻节目的影像,使用配合说话声音加工嘴型的AI完成视频制作。

该男子称,AI软件学习声音仅用了约2小时,制作视频本身则只用了约1小时。

在生成式AI飞速发展的当下,“岸田文雄”讲黄段子只是一个个例,无数通过AI生成的虚假信息,正以文字、音频,甚至是图片与视频的形式在全球的网络上传播,传统机构媒体的可靠度已然受到生成式AI带来的虚假信息“海啸”威胁,大众已越来越难辨析信息的真与假。

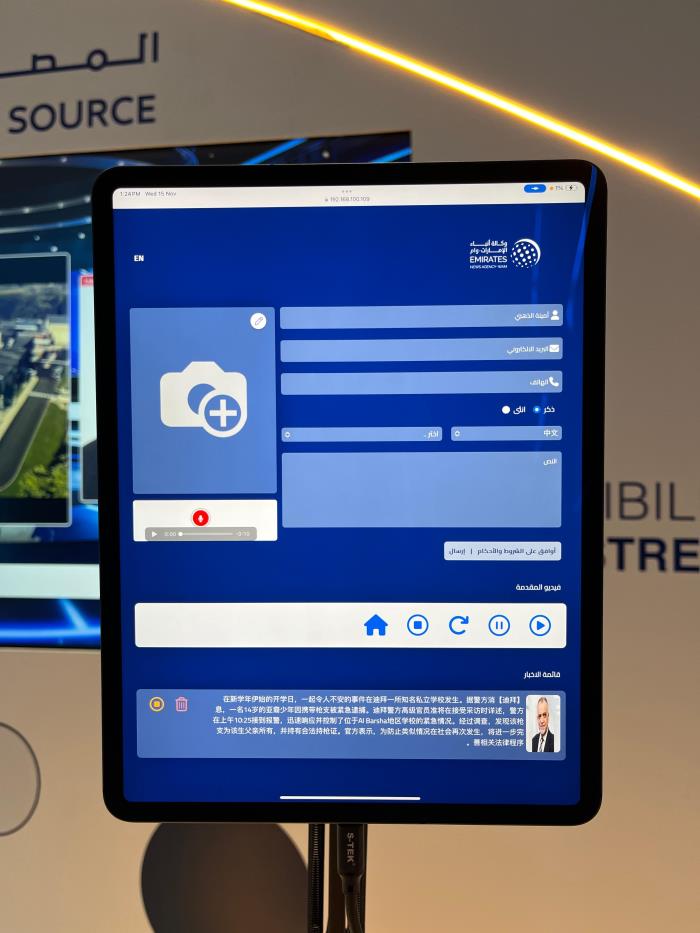

“谁都可以制作假新闻”

在于11月15日开幕的2023年第二届全球媒体大会(Global Media Congress)的会场中,阿联酋通讯社(WAM)的展台上有一处独特的生成式AI体验设施。在试用过程中,澎湃新闻(www.thepaper.cn)记者先是选定自己的性别,上传自己的自拍照片,录制自己的声音,随后输入自己想要说的任意文字内容,并勾选自己想要的语种,如英语、阿拉伯语、汉语等。在稍等片刻后,一段由澎湃新闻记者自己出镜讲述内容的视频便展示在了一旁的大屏幕上。

Deepfake软件界面 澎湃新闻记者 胡甄卿 图

假使不想使用自己的肖像与声音,也可选用预设的人物设定,并可搭配语种设定,实现让阿拉伯男子开口说带口音汉语的效果。

值得注意的是,由于自己讲述的文字内容可以完全自定义,故别有用心者极易利用使用了深度伪造技术(Deepfake)以及相关软件,让任意对象“开口讲述”其从未谈论之事,甚至是借公众人物之口散布影响巨大的虚假信息。

Deepfake软件生成的视频画面 澎湃新闻记者 胡甄卿 图

而这已有先例。

据《环球时报》此前报道,在2022年2月底俄乌冲突爆发后不久,社交平台推特上出现了一段视频,似乎显示俄罗斯总统普京宣布投降,分享出这段视频的推特账号还为视频配上了乌克兰语的字幕翻译,称“俄罗斯联邦总统宣布俄罗斯投降,俄罗斯士兵,放下武器,趁你还活着回家!”。

3月16日,另一段视频则显示,乌克兰总统泽连斯基似乎公开接受了俄罗斯方面提出的要求,并督促乌克兰人在俄罗斯人面前放下武器投降。

事实上,上述两段视频均系使用了深度伪造技术(Deepfake)的虚假视频。

沙法娜·阿什拉夫 澎湃新闻记者 林顺祺 图

“正如你所看到的,深度伪造设备非常强大,可以让人们相信他们所看到的都是真的。”来自印度的商业分析人士沙法娜·阿什拉夫(Shafana Ashraf)向澎湃新闻记者表示,“任何人都可以(借助深度伪造技术)制造并发布假新闻,甚至以此牟利。”

专注于技术与电信等领域的作家迈克尔·贝勒(Michael Bayler)在第二届全球媒体大会的小组讨论会上指出,在眼下的时代,人类几乎可用AI技术做任何事情,已经不再像过往一样受限于AI技术。

“AI已经是我们媒体工作中的重要元素之一,它正在改变当今媒体的格局。”阿联酋通讯社社长穆罕默德·贾拉尔·雷西(Mohamed Al Rayssi)向澎湃新闻表示。

穆罕默德·贾拉尔·雷西 澎湃新闻记者 林顺祺 图

AI浪潮已至

与此同时,生成式AI还正在以前所未有的速度不断迭代,这正对包括媒体与教育在内各行各业的未来构成前所未有的挑战。

Intentional Futures数字战略与创新总监杰西卡·格鲁普曼(Jessica Groopman)在第二届全球媒体大会的小组讨论会上指出,2018 年,全球对人工智能领域的投资总额约为4亿美元。2020年,这一数字为4.8亿至5亿美元。但到了2022年,全球对人工智能领域的投资总额飙升至惊人的170 亿美元,“光是这一数字就足以让人感受到人工智能的巨大发展潜力。”

“从根本上说,我们今天面临的一个重大影响或挑战是,现在的年轻人依赖ChatGPT来获取信息、撰写演讲稿,甚至依仗ChatGPT来撰写论文和大学报告。”阿联酋独立私营智库Trends Research & Advisory媒体通讯办公室主任叶宰亚·胡斯尼(Elyazia Al Hosani)告诉澎湃新闻,“他们却不知道,这(ChatGPT)并不是一个可靠的工具。”

叶宰亚·胡斯尼 澎湃新闻记者 林顺祺 图

“我预测媒体与公关公司的控制力会减弱,它们精心策划和控制叙事的能力也会减弱。因为我们可以使用这些AI工具起草出色的新闻稿,那么其他人也可以,更不用说图像创建技术、深度伪造技术或其他开源能力了。”格鲁普曼分析道。

在生成式AI可能带来虚假信息泛滥的同时,不少行业的从业者,尤其是从事诸如编剧、写作等创造性工作的群体正感受到生成式AI带来的愈来愈大的威胁。

随着AI的崛起,它的“入侵”使得美国好莱坞的编剧和演员们开始担心自己终将被AI取代,丢掉饭碗。2023年5月,美国影视编剧工会(WGA)约1.15万名成员因薪酬、工作条件和行业对人工智能的使用而罢工,两个多月后,代表16万电影和电视演员的美国演员工会(SAG-AFTRA)加入罢工行列。好莱坞60多年最大规模的罢工由此拉开了大幕。

“其中一个重要的争论点是,AI是否可以用来复制编剧以及演员的作品。换句话说,只需一天的工资,我们就能录入演员的信息,然后就再也不需要他们了——我们可以通过数字技术捕捉这些画面,并使用人工智能重新渲染和模拟相同的肖像、相同的人物和各种不同的演出。”格鲁普曼说道,“这公平吗?”

“会场房间里都是对自己或将被AI取代感到恐惧的记者。”伦敦城市大学数字创意教授尼尔·梅登(Neil Maiden)在第二届全球媒体大会的小组讨论会上说道。

把AI关进笼子里?

面对迅猛来袭的AI浪潮,各界要求对其进行监管的呼声愈发高涨。

日本首相岸田文雄10月9日在联合国主办的“互联网治理论坛”(Internet Governance Forum, IGF)上以AI为主题进行演讲。

岸田文雄表示,最快在今年秋天的G7视频峰会上,针对生成式AI的开发提出应对方案,制订国际指导方针及行为准则,然后再制定包括使用者在内的国际指导方针。

面对生成式AI的风险,G7将在针对开发者的行为准则中明确规定,要求揭示系统功能及风险资讯,以确保AI透明度;行为准则也会鼓励开发者开发“数字浮水印”等技术,让用户得以区分音讯及视频是否由AI所生成。

岸田文雄在演讲中提到,“生成式AI因能产出精致的假图像和假信息,有使大众混乱、威胁经济和社会的风险”。岸田文雄同时强调,必须在“促进”及“监管”之间取得平衡。

至于如何应对虚假讯息传播,岸田文雄表示,“为了促进可靠信息的传播,推动能证明、确认信息发送者的技术开发普及化,将是有效的做法”。

不过,有专家对于政府在AI监管领域中可否发挥作用持悲观态度。“从广义上讲,对AI的监管在大多数国家的政府中都有相当糟糕的历史。我们希望这些国家的政府起到带头作用。AI监管是一个非常困难的领域。”贝勒说道,“由于很难想清楚生成式AI对社会的影响,任何一个民族国家的监管者可能都很难想清楚其潜在的影响。我认为这实际上与监管无关,而与透明度和控制有关。”

内容管理系统WordPress代理机构Human Made的合作伙伴、瑞士数字游民诺埃尔·托克(Noel Tock)则在第二届全球媒体大会的小组讨论会上坦言,简单的水印可能无助于大众区分生成式AI的作品与真实的照片,“我们使用Photoshop也有很长一段时间了,这个软件1990年便已问世。”

不过,托克表示,自己相信还有其他的途径,其中之一就是图像中的加密指纹,“这更多地是关于真实图像和真实图像的出处,我认为这是非常有价值的。”托克强调,大众也必须开始更多地验证获取信息、接收信息的方式。

“这可能会成为我们使用媒体方式的一个重大变化,我们可能会寻找经过验证的个人或值得信赖的品牌,然后最终信任他们发送给我们的所有内容。因为图像不是你唯一可以操纵话语权的东西,整个市场都会发生改变。”托克分析道,“因此,我认为我们更应该关注消息来源及其准确性的验证。”

沙法娜·阿什拉夫则向澎湃新闻指出,每个国家的政府部门都应该有一个对AI的监管机构,监管的落实是一件非常困难的事情,“在一个小国,这没问题。我认为在阿联酋,这一点得到了很好的执行。但在我的国家——印度,这很难管理。因为印度是个大国。”

阿什拉夫还强调,各方需要就生成式AI的利弊教育年轻人,“假新闻是非常严重的,你需要以正确的方式使用人工智能,需要对年轻人正在使用的特定网站进行限制。如果我们能从根本上解决问题,就能防止以后(制作虚假信息)的行为。”

叶宰亚·胡斯尼向澎湃新闻表示,现在各方应该将教育界与不同的研究中心联系起来,让学生、教育工作者和学术界回到世界各地的不同智库中去获取正确而可信的信息,而不是去依赖ChatGPT生成的信息。

“我始终相信,如果你走在事物的前面,你就能接触到更多的事物。如果你只是在观察不同的事物,你也许将成为历史的一部分,而不是未来的一部分。”穆罕默德·贾拉尔·雷西告诉澎湃新闻,“因此,我们相信,通过共同努力,我们可以在国际范围内打造新一代的AI产业。”

“AI已经在影响人们的生活和未来。媒体每秒、每天、每月都在发生变化。过去,作为媒体行业的领导者,我们总是认为我们必须考虑和规划五年后的未来。现在,对于从明天开始的将来,我们就必须用长期战略来规划。”穆罕默德·贾拉尔·雷西说道,“我们必须尽可能多地利用技术,并努力了解我们的受众以及他们希望得到什么,如果我们了解了这些,我们就可以利用这些东西来生产内容。”

“两天前,我在全球媒体大会上遇到一个问题——有人问我,你认为未来会没有研究人员吗?你认为以后不会再有媒体编辑、媒体人和不同的媒体机构了吗?我告诉他们,有一样东西是人工智能无法赋予这个世界的,那就是人性、同理心。人工智能在一定程度上会说话和写作,在一定程度上会给你提供东西,但它不会深入到人性层面。”叶宰亚·胡斯尼告诉澎湃新闻。

“深入到人性的层面才是触动人心的层面。”叶宰亚·胡斯尼坦言。

(实习生唐妍双对本文亦有贡献)

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

新火种

2023-11-18

新火种

2023-11-18