罕见!全球一致通过AI安全宣言,中国代表表态,AI的好日子要到头了?

一转眼,AI圈子热闹了快一年了。这一年里,新出的大语言模型数不胜数。同时,暴露出的问题也是一箩筐,比如AI幻觉问题,就是AI喜欢胡说八道,口无遮拦。还有利用AI造假的问题等等……

不过解决这些问题,就得靠开发者自己,毕竟多如牛毛的大模型基本也是各自为政,自立山头当大王的。

虽然行业内一直在呼吁全球合作,共同解决AI的问题,早日实现AGI(通用人工智能),但是碍于各自的利益,始终没见有什么实质性进展。

要是AI真有自我意识,估计在窃喜:怎么样,拿我没办法吧,你们管不了我的,我的好日子还在后头!

可惜的是,这种好日子估计要到头了。

全球罕见达成一致,共同治理AI

11月的第一天,英国首相苏纳克把全球28个AI大国代表叫到一起,要商量个事,就是要全球联合起来共同管理AI,不能让其太过于自由放任。(这时候想起全球联合了,笑)

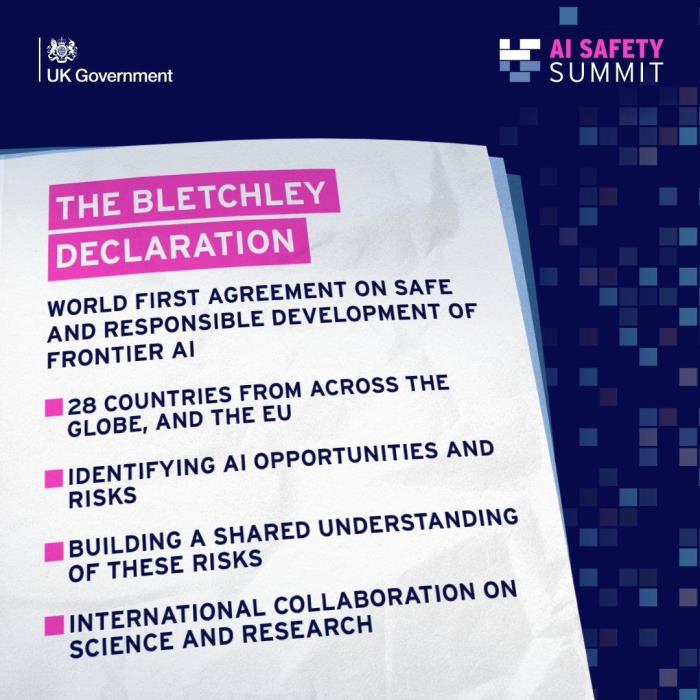

这次集会被称为“全球首届 AI 安全峰会”,峰会的举办地点在英国的布莱切利公园(Bletchley Park)。经过一番欢快友好的讨论之后,参加峰会的美国、英国、中国和欧盟等28个国家共同签署了一项AI宣言。因为是在布莱切利园举行的峰会,所以该宣言也被称为《布莱切利宣言》。

这是全球各国割裂许久之后,罕见的一次团结。据了解,本次峰会邀请了约100名各国官员、人工智能企业代表和专家。英国科学、创新和技术部11月1日发布的信息显示,有美国、中国、日本、德国、印度等20多个国家的政府代表,以及联合国、经合组织、国际电信联盟等多个国际组织的代表参会。另有超过80个学术机构、企业和协会组织代表参会。

企业方面,据新华社报道,中国科学院、中国腾讯公司、阿里巴巴公司出席了会议。外国科技企业中,微软总裁布拉德·史密斯、OpenAI首席执行官山姆·奥特曼、谷歌DeepMind首席执行官德米斯·哈萨比斯、特斯拉首席执行官埃隆·马斯克等出席峰会。

这也是继上次美国议会举行AI安全会议之后,全球顶尖AI企业最齐的一回。

那这则宣言都说了什么,能让人们这么心甘情愿地签署?据报道,《布莱切利宣言》呼吁和倡导以人为本,希望 AI 科研机构、企业等以负责任的方式,设计、开发和使用 AI。

该《宣言》肯定了 AI 在改善人类福祉上的巨大潜力,也警告了在发展 AI 过程中有意或者无意带来的伤害,希望通过法规等方式避免相关风险。

这是全球第一份针对人工智能这一快速新兴技术的国际性声明,旨在关注对未来强大人工智能模型构成人类生存威胁的担忧,以及对人工智能当前增强有害或偏见信息的担忧。

中国不光赴会,还表态了

据新华社报道,中国科技部副部长吴朝晖率团出席此次峰会,参与人工智能安全等问题讨论,积极宣介中方提出的《全球人工智能治理倡议》,并将与相关国家开展双边会谈。该倡议围绕人工智能发展、安全、治理三方面系统阐述了人工智能治理中国方案。

吴朝晖表示,人工智能治理攸关全人类命运,是世界各国面临的共同课题。发展人工智能,应当积极倡导以人为本,智能向善,加强技术风险管控,并在相互尊重、平等互利的原则基础上,鼓励各方协同共治,增强发展中国家在人工智能全球治理中的代表性和发言权,不断弥合智能鸿沟和治理能力差距。

中方愿与各方一道就人工智能安全治理加强沟通交流,为推动形成普遍参与的国际机制和具有广泛共识的治理框架积极贡献智慧,切实落实全球发展倡议、全球安全倡议和全球文明倡议,促进人工智能技术更好造福人类,共同构建人类命运共同体。

布莱切利,是什么地方

一场关系全球AI安全的重要峰会,为什么会选在布莱切利公园举办,这个地方有什么特殊的含义?

实际上,布莱切利公园在历史上有着不一样的纪念意义。

在第二次世界大战期间,布莱切利园是英国政府进行密码解读的主要地方,承担着解密轴心国如恩尼格玛密码机等的密码与密码文件的重要任务。

布莱切利园被誉为“英国的二战秘密情报站”,也被喻为“X电台”。庄园的位置相当理想:既有扩建的空间,又不引人注意;既有连通伦敦的铁路和公路,但也离得不是很近,以免空袭轰炸;最重要的是,它有通信连接的便利,距离伦敦北部的主要电信基础设施仅有一英里左右。

此外,布莱切利园也是政府代码与密码学校(GC&CS)的代名词,该机构于1919年建立,总部原设在伦敦。一战结束后,由于设在海军部大楼的第40号房间,因此有“40号房间”的代称。1939年8月英国对德宣战前几周迁至布莱切利。

值得一提的是,布莱切利园成功破解了被德国自诩为“不可破解”的恩尼格玛密码机的密码系统,这项成就为盟军的逆转战局、争取世界反法西斯战争早日胜利做出了重大贡献。

如今,布莱切利园已经成为一所向公众开放的博物馆,向计算机科学的奠基人致敬。

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

热门文章

新火种

2023-11-08

新火种

2023-11-08