OpenAI内部AGI项目或威胁人类,也成Altman被解雇导火索!

编辑:编辑部

【新智元导读】Sam Altman在APEC上曾暗示,OpenAI已经开发出比现在GPT-4更强大、远远超出人们期待的东西。一天后,他被解雇了。一封据称发给董事会的警告信也显示,OpenAI的某个模型,内部已产生重大飞跃。Sam Alman被解雇,又曝出最新内幕!

据路透社报道,就在他被解雇的前四天,OpenAI内部的研究员曾向董事会发了一封警告信,称发现了一个可能威胁人类的强大人工智能。

知情人士表示,这封此前从未报道过的信,也是董事会最终罢免Altman的导火索之一。

据称,曾任OpenAI临时CEO的Mira Murati,在周三提到了这个名为Q*(读作Q-Star)的项目,并且在「政变」发生之前给董事会写过一封信。

董事会觉得,Altman瞒着董事会在推进可能威胁人类的项目。

与此同时,有内部研究员认为,OpenaAI在Q*上取得的进展,将会成为AGI的一个重要突破!

不过,就在刚刚,TradingStrategy.ai联创表示,「AI重大突破」这个说法已被OpenAI内部人士打假。

APEC会议上的「危险」发言

印证Q*项目的另一事件,是Sam Altman在被解雇的一天,在APEC一次会议上的发言。

在那次会议上,他暗示了OpenAI已经开发出了比GPT-4更强大、更难以想象的东西,远超人们的期待。

模型的能力将会有一个无人预料到的飞跃。与人们的预期不同,这个飞跃是惊人的!

而这次发言,很可能也是他被解雇的导火索之一,会让Ilya等董事会成员认为,他隐瞒了许多信息。

现在正在发生的技术变革,将彻底改变我们生活方式、经济和社会结构以及其他可能性限制……这在OpenAI的历史上有四次 ,而最近一次,就是在过去几周内。

在拨开无知的面纱和探索未知的边界时,我有幸在场, 这是我职业生涯中的荣幸。

Q*就是AGI?

其中一位知情人士说,在与路透社联系后,拒绝置评的OpenAI在给员工的内部消息中,承认了一个名为Q*的项目,并在周末的活动前给董事会写了一封信。

OpenAI的一位发言人表示,这条消息由CTO Mira Murati发送,提醒员工注意某些媒体报道,但并没有对其准确性发表评论。

其中一位知情人士告诉路透社,OpenAI的一些人认为Q*(发音为Q-Star)可能是OpenAI在AGI上取得的一个突破。

在OpenAI看来,AIG可以定义为「在最具经济价值的任务中,超越人类的自主系统」。

因为巨大的算力支持,新模型可以解决某些数学问题。虽然只是可以在小学水平上做数学题,但通过这样的测试,让研究者对Q*的未来非常乐观。

根据内部人士透露,在给董事会的信中,研究人员标记了AI的实力和潜在危险,但没有具体说明信中提到的确切安全问题。

另外,研究人员还标记了一个「人工智能科学家」团队的工作,有多个消息来源证实了该团队的存在。

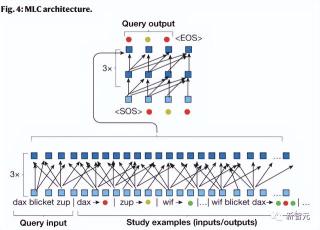

30多年前,Fodor和Pylyshyn提出的经典论点——神经网络由于其统计性质而从根本上缺乏人类的系统组合技能——给神经网络研究蒙上了长长的阴影

其中一位知情人士说,该小组由早期的「Code Gen」和「Math Gen」团队组成,正在探索如何优化现有的人工智能模型,以提高其推理能力,并最终进行科学工作。

项目由Ilya主导

据悉,一些OpenAI员工认为,Altman的言论应该指的是公司早些时候的一项创新,就是这项创新,能让他们开发出更强大的AI模型。

Ilya团队的这项工作,此前从未被报道过。

知情人士透露,这项由OpenAI首席科学家Ilya Sutskever主导的技术突破,引起了一些员工的担忧。他们担心公司没有合适的保障措施,来将这种先进的AI模型商业化。

在接下来的几个月里,OpenAI的高级研究人员又利用这项创新,建立了能够解决基本数学问题的系统。

经常用大模型的人都知道,数学问题对于现有的LLM,都是一项艰巨的任务。

根据The Information报道,OpenAI的两位研究员,Jakub Pachocki和Symon Sidor,利用Ilya的工作成果建立了一个名为Q*(读作「Q-Star」) 的模型。

据称,Q*模型能够解决它以前从未见过的数学问题,而这,是一个重要的技术里程碑。

最近几周内,该模型的演示一直在OpenAI内部流传,而AI的发展速度,也让安全研究人员感到震惊。

据内部人士爆料,Ilya的突破,使OpenAI不再受限于获取足够的高质量数据来训练新模型,而这,正是开发下一代模型的主要障碍。

这项研究涉及使用计算机生成的数据,而不是真实世界的数据,比如从互联网上提取的文本或图像。

多年来,Ilya一直在研究如何让GPT-4解决涉及推理的任务,比如数学或科学问题。

此前,Ilya在这个方向就有多年积累。21年,他启动了一个名为GPT-Zero的项目,这是对DeepMind AlphaZero的致敬。

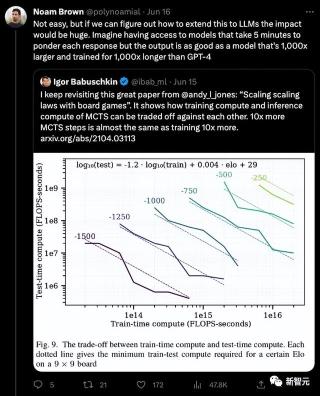

GPT-Zero可以下国际象棋、围棋和将棋。而团队假设,只要给大模型更多的时间和算力,假以时日,它们一定能达到新的学术突破。

而且在半年之前,就有硅谷大佬扒出,OpenAI很有可能会将「实时检索」和模型能力结合起来,创造出难以想象的AI能力。

尤其是针对LLM亟待提高的数理和推理能力,未来有可能会有极大提升。

在提出了这种可能性之后,他于两周之后就加入了OpenAI。

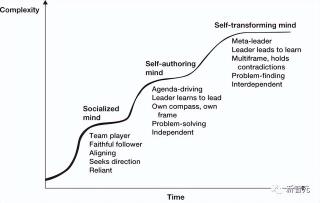

对齐派 VS 加速派

而即使在昨天Altman重返CEO之位后,高管之间的潜在分歧似乎仍未消除,因为OpenAI内部对工作进度的紧张关系仍在持续。

Ilya本人似乎对这项技术持保留意见。今年7月,他组建了对齐团队,致力于限制AI系统可能给人类带来的威胁。

在OpenAI的对齐团队看来,虽然超级AI还很遥远,但他们相信它会在十年内到来。

Pachocki和Sidor的立场,大概率是在Ilya对齐团队的反面。

上周Altman被解雇后,两人也迅速辞职。而Altman复职后,两人也随之回到了公司。

而OpenAI总裁兼联创Greg Brockman,对于这项技术也持支持态度,致力于将其整合到新产品中。他同样是在Altman复职后,随之回到了公司。

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

热门文章

新火种

2023-11-27

新火种

2023-11-27