超38TB私人文件泄露,微软员工的聊天记录都被看到了

推特上突然出现的一条消息引发了大家的关注。 博客文章:https://www.wiz.io/blog/38-terabytes-of-private-data-accidentally-expose-by-microsoft-ai-researchers?continueFlag=c833860be919eae699db06b9c426a0ce

博客文章:https://www.wiz.io/blog/38-terabytes-of-private-data-accidentally-expose-by-microsoft-ai-researchers?continueFlag=c833860be919eae699db06b9c426a0ce

Wiz 团队在 GitHub 上发现了一个公开的 AI 库,其中泄露了超过 38TB 的私人文件——包括微软员工的个人电脑备份。

泄露事件始末

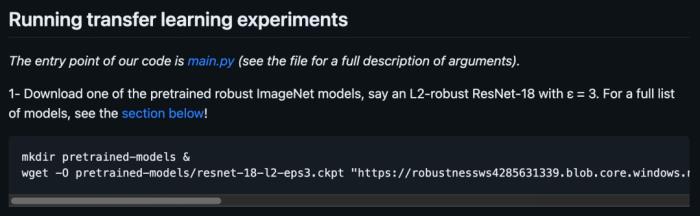

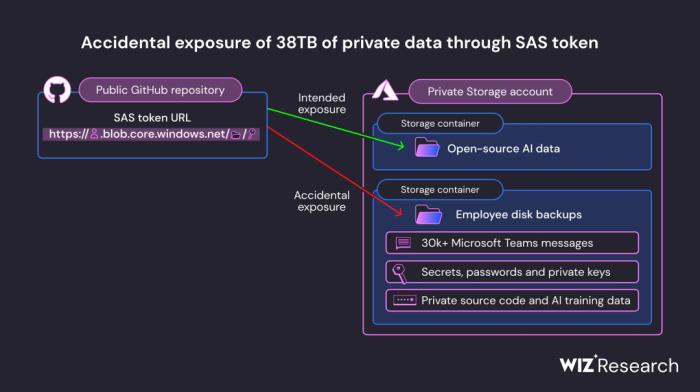

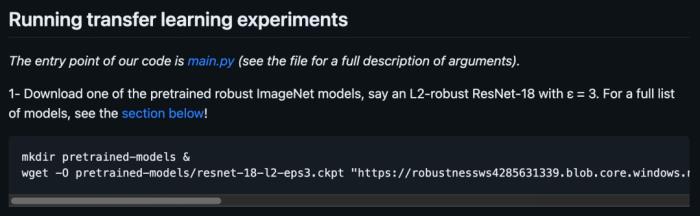

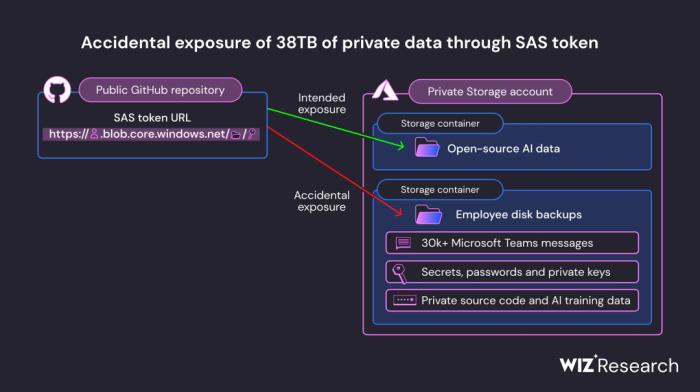

Wiz 团队进行了关于意外暴露云托管数据配置的工作时,扫描了互联网上配置错误的存储容器。在此过程中,他们发现微软组织下有一个名为robust-models-transfer的 GitHub 存储库。存储库属于微软的AI研究部门,旨在为图像识别提供开源代码和AI模型。该资源库的读者被指示从Azure存储URL下载模型: 从微软 GitHub 存储库中获取的公开存储 URL

从微软 GitHub 存储库中获取的公开存储 URL

不过,这个 URL 允许访问的不仅仅是开源模型。然而它被配置为争夺整个存储账户的权限,从而泄露了更多私人数据。

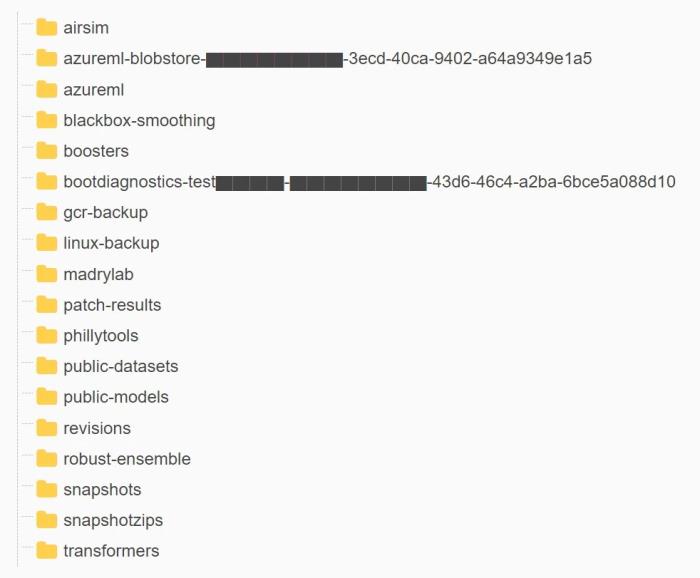

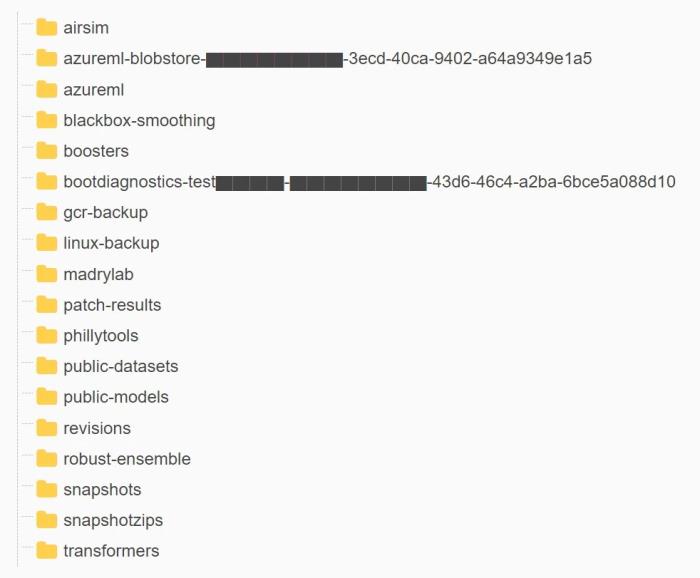

根据 Wiz 团队的扫描显示,该账户包含 38TB 的额外数据,其中包括微软员工的个人电脑备份。这些备份包含敏感的个人数据,包括微软服务的密码、密钥以及来自 359 名微软员工的 30,000 多条Microsoft Teams 内部消息。 robustnessws4285631339 存储账户内容泄露

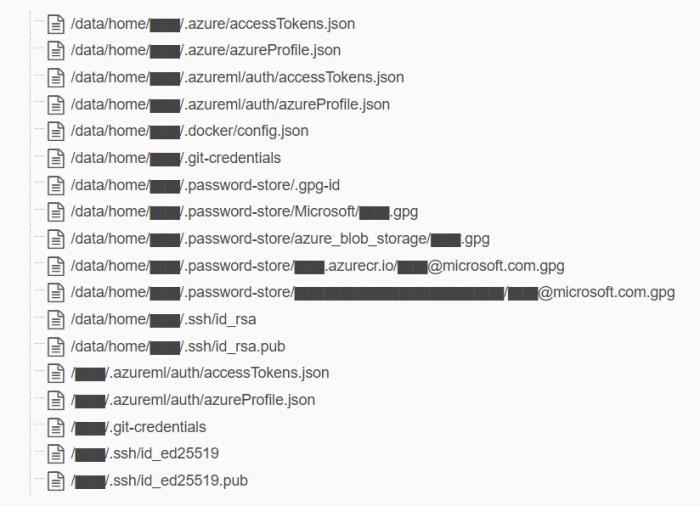

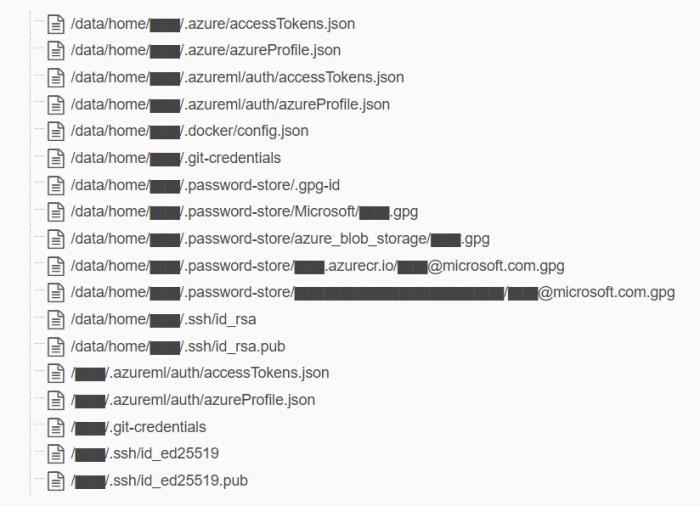

robustnessws4285631339 存储账户内容泄露 在电脑备份中发现部分敏感文件样本

在电脑备份中发现部分敏感文件样本 两个微软员工之间的对话

两个微软员工之间的对话

除了访问范围极其广泛之外,token还被错误配置为允许「完全控制」权限,而不是只读权限。这意味着,攻击者不仅可以查看存储账户中的所有文件,还可以删除和覆盖现有文件文件。

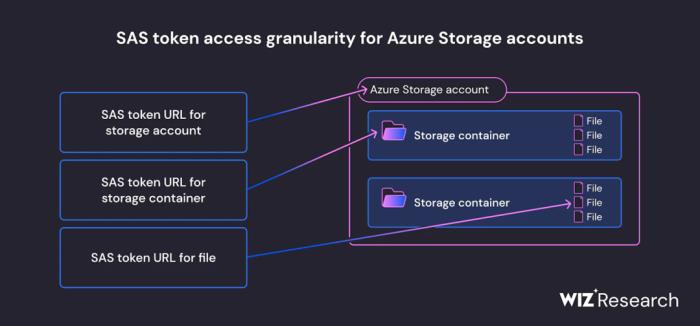

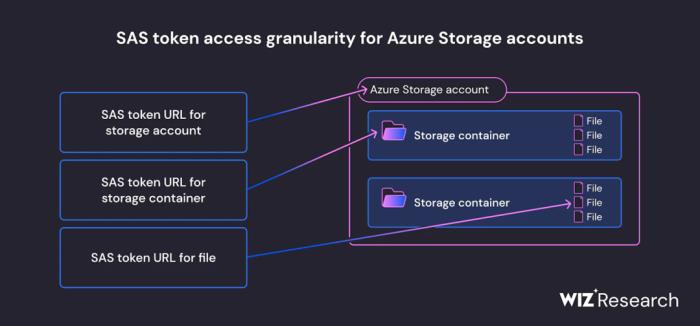

该存储库的最初目的:提供用于训练代码的AI模型。存储库指示用户从SAS链接下载模型数据文件,并提供其提供的脚本。文件格式为ckpt,是TensorFlow库生成的一种格式。使用 Python 的 pickle 筛选器进行格式化,而这很容易导致相关代码执行。这意味着,攻击者可以向该存储账户中的所有人工智能模型注入恶意代码,而每个信任微软 GitHub 存储库的用户都会因此受到感染。 不过,值得注意的是,这个账户存储并没有直接暴露给公众;事实上,它是一个私有存储账户。微软的开发人员使用了一种名为“SAS token”的 Azure 机制,该创建一个机制可共享的链接,授予对 Azure 存储账户的数据访问权限。经过检查,该存储账户看起来仍然是完全私有的。

不过,值得注意的是,这个账户存储并没有直接暴露给公众;事实上,它是一个私有存储账户。微软的开发人员使用了一种名为“SAS token”的 Azure 机制,该创建一个机制可共享的链接,授予对 Azure 存储账户的数据访问权限。经过检查,该存储账户看起来仍然是完全私有的。

微软也在博客上发表了对该事件进行了回应和解答。 博客文章:https://msrc.microsoft.com/blog/2023/09/microsoft-mitigated-exposure-of-internal-information-in-a-storage-account-due-to-overly-permissive-sas-token /

博客文章:https://msrc.microsoft.com/blog/2023/09/microsoft-mitigated-exposure-of-internal-information-in-a-storage-account-due-to-overly-permissive-sas-token /

微软表示,已经根据 Wiz 提供的报告进行了调查和修复。该事件涉及到一个微软员工,其共享了公共 GitHub 存储库中 blob 存储的 URL。该 URL 包含一个内部存储账户员工的过度许可共享访问签名(SAS)token。因此,Wiz的安全研究人员就可以使用该token访问存储账户中的信息。该存储账户中泄露的数据包括两名前员工工作站配置文件的备份,以及这两名员工与同事的内部Microsoft Teams 信息。没有数据用户被泄露,也没有其他内部服务该问题而面临风险。用户对此问题采取任何行动。

微软仍在博客中说到 SAS token提供的访问的机制,允许某些客户端连接到指定的 Azure 存储资源。在此机制案例中,微软的一位研究人员无意中在 blob 存储 URL 中包含了此SAS token,并在公共 GitHub 存储库中提供了该 URL。Azure 存储或 SAS token 功能不存在安全问题或漏洞。此外,微软正在进行持续改进,以进一步强化 SAS token 功能,并继续对服务进行评估,以加强默认安全状态。 Wiz 对 SAS 令牌的介绍图标

Wiz 对 SAS 令牌的介绍图标

微软表示,在发现该漏洞后,Wiz 于 2023 年 6 月 22 日向微软安全响应中心 (MSRC) 报告了该问题。接到通知后,MSRC 与相关研究和工程团队合作,于 2023 年 6 月 24 日撤销了 SAS token并阻止了对存储账户的所有外部访问。

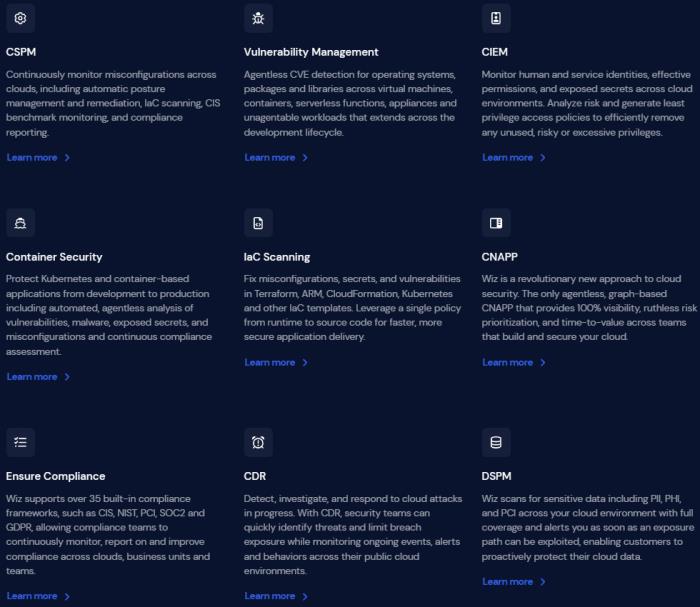

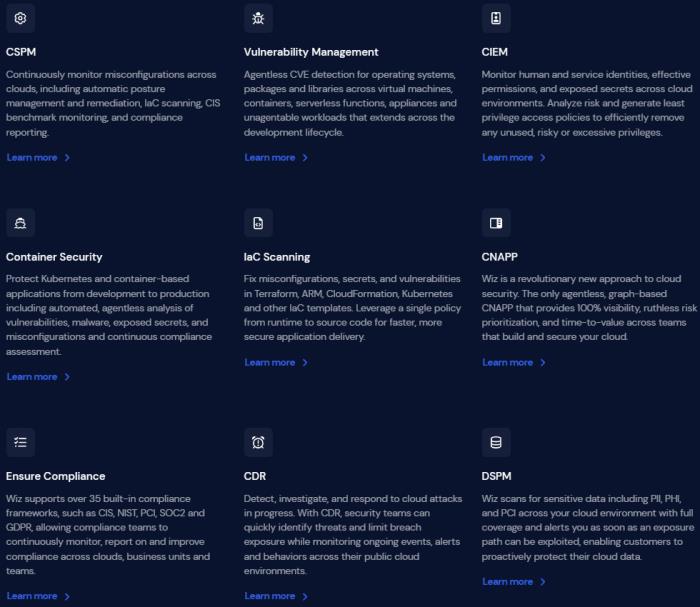

云原生安全公司 Wiz

Wiz 成立于 2020 年,由前微软云安全小组团队成员创立,包括 Assaf Rappaport、Yinon costi、Roy Reznik 和 Ami Luttwak 等。公司名称 WIZ 代表 Wizard,即巫师,指具有魔法能力的人。WIZ 认为,魔术其本质是通过对环境的深刻理解并使用自然手段来创建看似不可能的结果来定义的,其公司正源于这种观念,旨在使用安全性方法来解决看似不可能的客户问题。 该公司主要着眼于云原生安全,帮助企业大规模保护其云基础架构,为企业安全提供了首个云可视化解决方案,提供了跨云、容器和工作负载安全风险视图,是首个全栈多云安全平台。

该公司主要着眼于云原生安全,帮助企业大规模保护其云基础架构,为企业安全提供了首个云可视化解决方案,提供了跨云、容器和工作负载安全风险视图,是首个全栈多云安全平台。 Wiz可以让客户公司几乎可以即时覆盖整个多云环境,把风险关联起来,将信号与噪声分开。Wiz不只是识别风险,而且对它们进行优先排序并找到其他技术无法找到的攻击媒介。

Wiz可以让客户公司几乎可以即时覆盖整个多云环境,把风险关联起来,将信号与噪声分开。Wiz不只是识别风险,而且对它们进行优先排序并找到其他技术无法找到的攻击媒介。

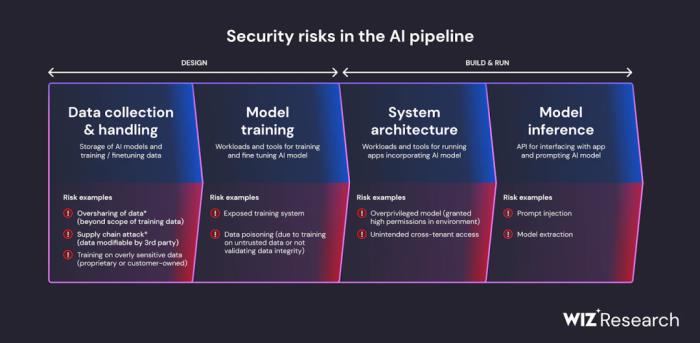

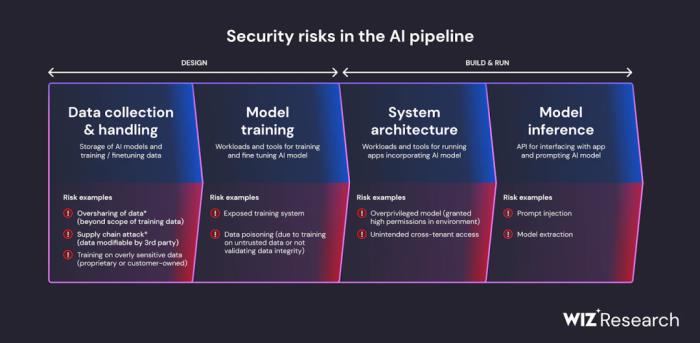

在那件事例中 Wiz 提到的,企业在使用 AI 时,安全团队必须了解 AI 开发过程中每个阶段的安全风险。 首先是数据过度共享。研究人员收集并共享大量外部和内部数据,以构建AI模型所需的训练信息。这就带来了与大规模数据共享相关的固有安全风险。安全团队必须为AI数据集安全的外部共享制定了明确的指导方针。正如本事例中,将公共人工智能数据集分离到专用账户存储可以限制风险。

首先是数据过度共享。研究人员收集并共享大量外部和内部数据,以构建AI模型所需的训练信息。这就带来了与大规模数据共享相关的固有安全风险。安全团队必须为AI数据集安全的外部共享制定了明确的指导方针。正如本事例中,将公共人工智能数据集分离到专用账户存储可以限制风险。

其次是供应链攻击风险。由于权限不当,公共令牌获得了对包含AI模型存储账户的写访问权限。在模型文件中注入恶意代码可能会导致对使用存储库模型的其他研究人员的供应链攻击。安全团队应审查和清理来自外部的AI模型,因为它们可以用作远程代码执行向量。

参考链接:https://www.nsfocus.com.cn/html/2021/21_0513/943.htmlhttps://www.wiz.io/blog/38-terabytes-of-private-data-accidentally-expose-by-microsoft-ai-researchers?continueFlag=c833860be919eae699db06b9c426a0cehttps://msrc.microsoft.com/blog/2023/09/microsoft-mitigated-exposure-of-internal-information-in-a-storage-account-due-to-overly-permissive-sas-token/

博客文章:https://www.wiz.io/blog/38-terabytes-of-private-data-accidentally-expose-by-microsoft-ai-researchers?continueFlag=c833860be919eae699db06b9c426a0ce

博客文章:https://www.wiz.io/blog/38-terabytes-of-private-data-accidentally-expose-by-microsoft-ai-researchers?continueFlag=c833860be919eae699db06b9c426a0ceWiz 团队在 GitHub 上发现了一个公开的 AI 库,其中泄露了超过 38TB 的私人文件——包括微软员工的个人电脑备份。

泄露事件始末

Wiz 团队进行了关于意外暴露云托管数据配置的工作时,扫描了互联网上配置错误的存储容器。在此过程中,他们发现微软组织下有一个名为robust-models-transfer的 GitHub 存储库。存储库属于微软的AI研究部门,旨在为图像识别提供开源代码和AI模型。该资源库的读者被指示从Azure存储URL下载模型:

从微软 GitHub 存储库中获取的公开存储 URL

从微软 GitHub 存储库中获取的公开存储 URL不过,这个 URL 允许访问的不仅仅是开源模型。然而它被配置为争夺整个存储账户的权限,从而泄露了更多私人数据。

根据 Wiz 团队的扫描显示,该账户包含 38TB 的额外数据,其中包括微软员工的个人电脑备份。这些备份包含敏感的个人数据,包括微软服务的密码、密钥以及来自 359 名微软员工的 30,000 多条Microsoft Teams 内部消息。

robustnessws4285631339 存储账户内容泄露

robustnessws4285631339 存储账户内容泄露 在电脑备份中发现部分敏感文件样本

在电脑备份中发现部分敏感文件样本 两个微软员工之间的对话

两个微软员工之间的对话除了访问范围极其广泛之外,token还被错误配置为允许「完全控制」权限,而不是只读权限。这意味着,攻击者不仅可以查看存储账户中的所有文件,还可以删除和覆盖现有文件文件。

该存储库的最初目的:提供用于训练代码的AI模型。存储库指示用户从SAS链接下载模型数据文件,并提供其提供的脚本。文件格式为ckpt,是TensorFlow库生成的一种格式。使用 Python 的 pickle 筛选器进行格式化,而这很容易导致相关代码执行。这意味着,攻击者可以向该存储账户中的所有人工智能模型注入恶意代码,而每个信任微软 GitHub 存储库的用户都会因此受到感染。

不过,值得注意的是,这个账户存储并没有直接暴露给公众;事实上,它是一个私有存储账户。微软的开发人员使用了一种名为“SAS token”的 Azure 机制,该创建一个机制可共享的链接,授予对 Azure 存储账户的数据访问权限。经过检查,该存储账户看起来仍然是完全私有的。

不过,值得注意的是,这个账户存储并没有直接暴露给公众;事实上,它是一个私有存储账户。微软的开发人员使用了一种名为“SAS token”的 Azure 机制,该创建一个机制可共享的链接,授予对 Azure 存储账户的数据访问权限。经过检查,该存储账户看起来仍然是完全私有的。微软也在博客上发表了对该事件进行了回应和解答。

博客文章:https://msrc.microsoft.com/blog/2023/09/microsoft-mitigated-exposure-of-internal-information-in-a-storage-account-due-to-overly-permissive-sas-token /

博客文章:https://msrc.microsoft.com/blog/2023/09/microsoft-mitigated-exposure-of-internal-information-in-a-storage-account-due-to-overly-permissive-sas-token /微软表示,已经根据 Wiz 提供的报告进行了调查和修复。该事件涉及到一个微软员工,其共享了公共 GitHub 存储库中 blob 存储的 URL。该 URL 包含一个内部存储账户员工的过度许可共享访问签名(SAS)token。因此,Wiz的安全研究人员就可以使用该token访问存储账户中的信息。该存储账户中泄露的数据包括两名前员工工作站配置文件的备份,以及这两名员工与同事的内部Microsoft Teams 信息。没有数据用户被泄露,也没有其他内部服务该问题而面临风险。用户对此问题采取任何行动。

微软仍在博客中说到 SAS token提供的访问的机制,允许某些客户端连接到指定的 Azure 存储资源。在此机制案例中,微软的一位研究人员无意中在 blob 存储 URL 中包含了此SAS token,并在公共 GitHub 存储库中提供了该 URL。Azure 存储或 SAS token 功能不存在安全问题或漏洞。此外,微软正在进行持续改进,以进一步强化 SAS token 功能,并继续对服务进行评估,以加强默认安全状态。

Wiz 对 SAS 令牌的介绍图标

Wiz 对 SAS 令牌的介绍图标微软表示,在发现该漏洞后,Wiz 于 2023 年 6 月 22 日向微软安全响应中心 (MSRC) 报告了该问题。接到通知后,MSRC 与相关研究和工程团队合作,于 2023 年 6 月 24 日撤销了 SAS token并阻止了对存储账户的所有外部访问。

云原生安全公司 Wiz

Wiz 成立于 2020 年,由前微软云安全小组团队成员创立,包括 Assaf Rappaport、Yinon costi、Roy Reznik 和 Ami Luttwak 等。公司名称 WIZ 代表 Wizard,即巫师,指具有魔法能力的人。WIZ 认为,魔术其本质是通过对环境的深刻理解并使用自然手段来创建看似不可能的结果来定义的,其公司正源于这种观念,旨在使用安全性方法来解决看似不可能的客户问题。

该公司主要着眼于云原生安全,帮助企业大规模保护其云基础架构,为企业安全提供了首个云可视化解决方案,提供了跨云、容器和工作负载安全风险视图,是首个全栈多云安全平台。

该公司主要着眼于云原生安全,帮助企业大规模保护其云基础架构,为企业安全提供了首个云可视化解决方案,提供了跨云、容器和工作负载安全风险视图,是首个全栈多云安全平台。 Wiz可以让客户公司几乎可以即时覆盖整个多云环境,把风险关联起来,将信号与噪声分开。Wiz不只是识别风险,而且对它们进行优先排序并找到其他技术无法找到的攻击媒介。

Wiz可以让客户公司几乎可以即时覆盖整个多云环境,把风险关联起来,将信号与噪声分开。Wiz不只是识别风险,而且对它们进行优先排序并找到其他技术无法找到的攻击媒介。在那件事例中 Wiz 提到的,企业在使用 AI 时,安全团队必须了解 AI 开发过程中每个阶段的安全风险。

首先是数据过度共享。研究人员收集并共享大量外部和内部数据,以构建AI模型所需的训练信息。这就带来了与大规模数据共享相关的固有安全风险。安全团队必须为AI数据集安全的外部共享制定了明确的指导方针。正如本事例中,将公共人工智能数据集分离到专用账户存储可以限制风险。

首先是数据过度共享。研究人员收集并共享大量外部和内部数据,以构建AI模型所需的训练信息。这就带来了与大规模数据共享相关的固有安全风险。安全团队必须为AI数据集安全的外部共享制定了明确的指导方针。正如本事例中,将公共人工智能数据集分离到专用账户存储可以限制风险。其次是供应链攻击风险。由于权限不当,公共令牌获得了对包含AI模型存储账户的写访问权限。在模型文件中注入恶意代码可能会导致对使用存储库模型的其他研究人员的供应链攻击。安全团队应审查和清理来自外部的AI模型,因为它们可以用作远程代码执行向量。

参考链接:https://www.nsfocus.com.cn/html/2021/21_0513/943.htmlhttps://www.wiz.io/blog/38-terabytes-of-private-data-accidentally-expose-by-microsoft-ai-researchers?continueFlag=c833860be919eae699db06b9c426a0cehttps://msrc.microsoft.com/blog/2023/09/microsoft-mitigated-exposure-of-internal-information-in-a-storage-account-due-to-overly-permissive-sas-token/

相关推荐

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

热门文章

新火种

2023-10-29

新火种

2023-10-29